Виктор Носко: «Мы создаём российского конкурента ChatGPT»

Беседуем с создателем чат-ботов о нейросетях-трансформерах, сильном ИИ и боте FractalGPT, который будет развиваться сам.

Компания «Аватар Машина» специализируется на проектах, связанных с ИИ, — в частности, нейросетях-трансформерах, обрабатывающих естественный язык (NLP). Самый известный её проект — бот-психолог «Сабина Ai».

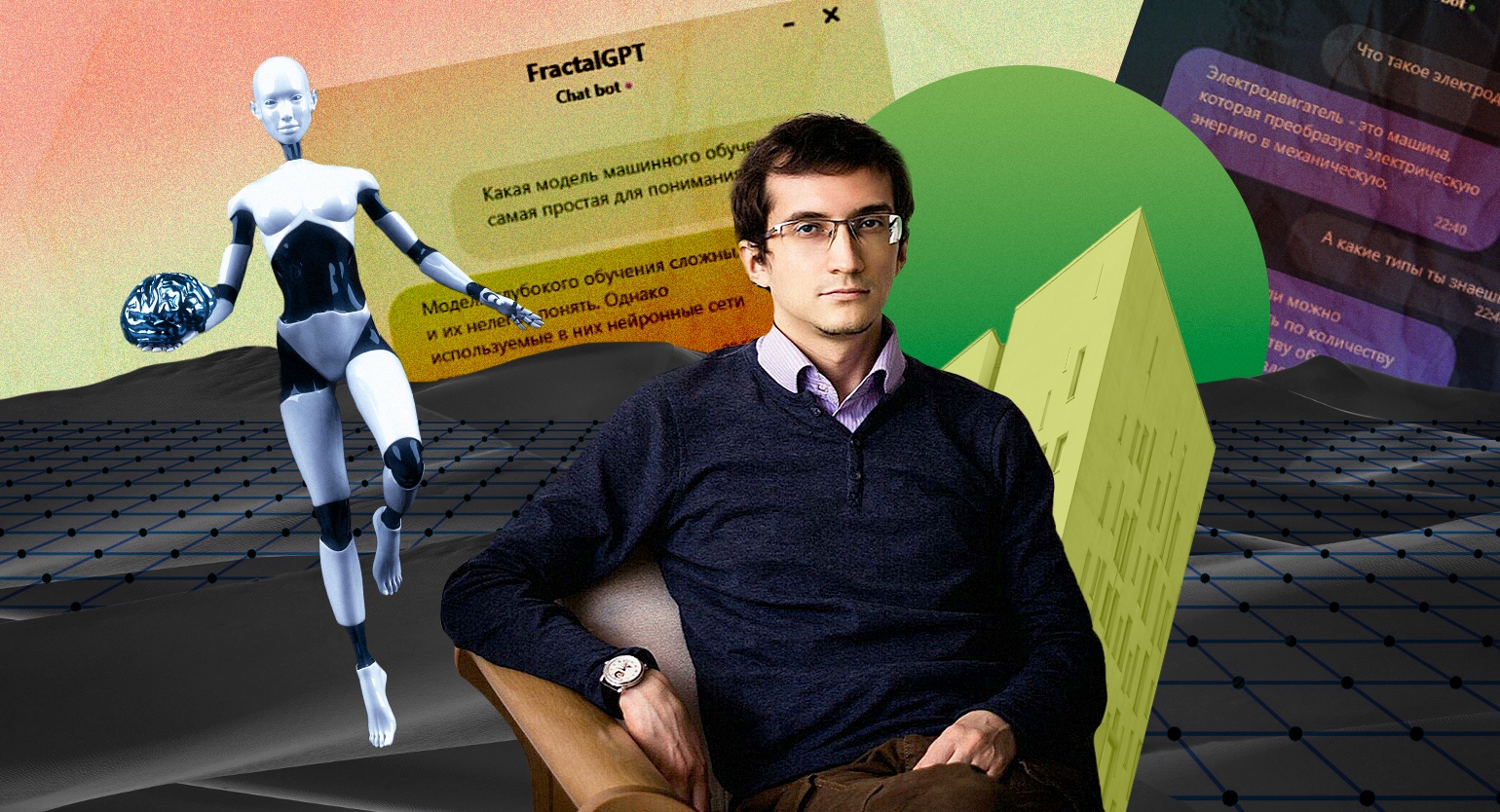

Генеральный директор «Аватар Машины» Виктор Носко поделился с нами информацией о новой разработке — чат-боте FractalGPT. По словам предпринимателя, этот бот, в отличие от конкурентов, не будет генерировать бред и при этом обретёт эмоции и способность к целеполаганию.

Виктор Носко

Основатель и генеральный директор компании «Аватар Машина», специалист в области генеративных нейросетей архитектуры Transformer, интерпретируемого ИИ. Спикер конференций по искусственному интеллекту: Conversations, OpenTalks.AI, AGIConf, DataStart, AiMen. Создатель чат-бота-психолога «Сабина Ai».

От стартапа до аватара

— Как вы пришли к идее основать собственную компанию?

— Мы с командой единомышленников уже много лет занимаемся разработкой ПО и научными исследованиями, связанными с ИИ. Первую компанию я основал в 2014 году. Уже через год она стала резидентом Южного ИТ-парка на моей малой родине, в Ростове-на-Дону. На стадии pre-seed наш стартап получил от венчурного инвестора финансирование, которое позволило заняться созданием нового продукта.

Мы хотели анализировать поведение людей, больших сообществ, их влияние друг на друга. Например, в интернете — через комментарии или сообщения в блогах. Описав структуру сообщества в виде графа, визуализировав её, можно оценить интересы группы. Существуют эффективные алгоритмы для анализа графов. Мы такой анализ делали для различных задач. Он был полезен и для бизнеса, и для политики.

«Аватар Машина» появилась в 2020 году, когда мы выиграли грант Фонда содействия инновациям и плотно занялись нейросетями типа Transformer. Мы решили, что будем заниматься тем, что нам по-настоящему интересно. По складу ума мы скорее учёные, чем бизнесмены. Наверное, я ближе всех к предпринимателям, хотя тоже занимаюсь наукой.

У нас есть потребность изучать и создавать ИИ в его различных ипостасях. Чат-боты идеально подошли в качестве точки приложения усилий. Они нужны бизнесу, находятся на переднем крае науки и при этом не требуют запредельных трат на серверы и инфраструктуру, как computer vision.

— Почему вы не стали делать простеньких ботов без нейросетей?

— Такие «шаблонные» боты — не наша тема. Они не дают ощущения живого разговора. Это не тот результат, к которому мы стремились. К тому же компании, разрабатывающие такие продукты, на рынке уже были. В их числе и крупные игроки типа «Сбера» и Just AI. А нам нужна была собственная свободная ниша.

Для нас этой нишей стали чат-боты, которые сейчас на хайпе: с ними можно свободно общаться, они поддерживают контекст. Реплики не зашиты в них в готовом виде, а генерируются самой нейросетью.

— Сетями, подобными GPT-4 от OpenAI?

— Необязательно это будет именно модель, разработанная OpenAI. Различных архитектур генеративных трансформеров существует более 50 видов. У той же Hugging Face можно найти около 5000 версий под различные задачи. В качестве примеров могу назвать такие модели, как Т5, BERT, BART, LLaMA, Alpaca.

Но все их, конечно, нужно адаптировать под задачи бизнеса, дообучать. Есть множество нюансов. Допустим, стилистика моделей «из коробки» обычно не подходит для чат-ботов заказчиков без дополнительной доработки.

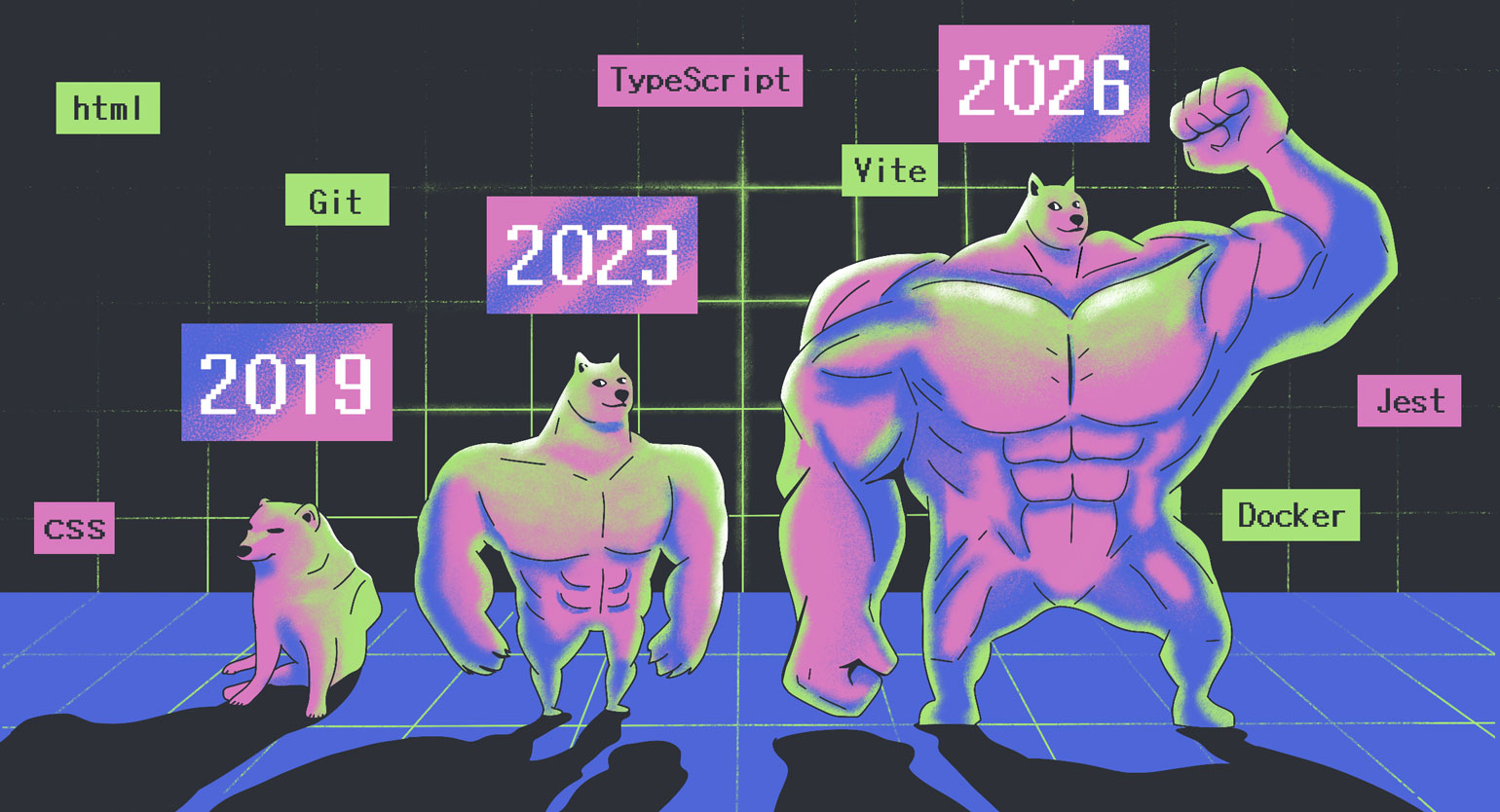

— Выход ChatGPT внёс коррективы в процесс создания ботов?

— Раньше, чтобы решить все задачи, любому бизнесу требовалось внедрить несколько моделей. В 2023 году ситуация кардинально изменилась. Появились решения, подобные ChatGPT, которые «тянут» много задач.

— И вы с 2020 года выполняете заказы на разработку чат-ботов?

— И не только. Мы также делали проект по контролируемой генерации. Наша программа создавала тексты новостей с обязательным упоминанием определённых ключевых слов. Но в качестве основного направления работы мы создаём брендовых ботов для бизнеса. Например, это может быть бот, который должен общаться с людьми с учётом специфики компании, но при этом делать это нешаблонно. То есть мы говорим о ботах-аватарах с различными характерами.

— Название компании происходит от идеи, что у ботов есть личность?

— Верно, была идея, что мы будем создавать ботов, наделённых «личностью», — имитировать реального человека или вымышленного героя. В качестве эксперимента мы даже обучали нейросеть стилистике Владимира Жириновского. Об этом сейчас все говорят, а мы уже давно такое делали. Причём на очень скромных моделях, если сравнивать с современными GPT. Между качеством и размером модели, конечно, есть взаимосвязь, но наши программы даже на небольших сетях нормально работали.

— Расскажите о вашей команде.

— Команда у нас распределённая, небольшая, в ней менее 10 человек. После пандемии все поняли, что можно работать удалённо. Офис у нас, конечно же, есть, но мы там не находимся постоянно. Наши сотрудники — это специалисты по data science с научным бэкграундом, разработчики-исследователи уровня senior.

Мы читаем большое количество препринтов на портале arxiv.org. За год изучаем до 300 статей. Это помимо новостей в специализированных СМИ, таких как «Код» Skillbox Media, за которыми тоже следим. Так и живём: выполняем заказы, зарабатываем деньги и занимаемся научными исследованиями.

Читайте также:

Фото: OpenTalks.AI

Технологии идеального трансформера

— Поделитесь «рецептом» идеального чат-бота для бизнеса.

— Для заказчиков обычно требуется создать бот, у которого есть несколько скиллов. Из них я, пожалуй, выделил бы три основных.

Первый подразумевает возможность поддерживать беседу, подобно человеку. Причём желательно — на любые темы.

Вторая фича — бот должен обладать некой личностью, а точнее, её эмуляцией. Это значит, что бот не только отвечает, как его зовут, но воспроизводит заданные особенности. Кстати, такой функции в «голом» GPT нет.

Третья — это фильтр токсичного контента. Нейросеть должна фильтровать негативные темы и высказывания: угрозы, мат, оскорбления и так далее.

— Трансформер — единственный тип архитектуры для такого бота?

— Если смотреть по соотношению «цена — качество», для бизнеса это, пожалуй, оптимальный вариант. При этом важно уточнить: мы говорим не о какой-то единственной модели, а о целом семействе трансформеров.

Впервые подобная архитектура была представлена в 2017 году, и с тех пор она активно развивается. Наши разработчики внимательно следят за всеми новинками, изучают, как работают различные гипотезы.

— Видел в вашей презентации упоминание технологии fast experts tuning, которая «ускоряет обучение трансформеров в 50 и более раз». Расскажите о ней.

— Эту технологию придумал наш Senior AI-researcher Захар Понимаш. Мы сделали адаптер, который позволяет дообучить нейросеть для некой узкой задачи всего за 2–3 минуты. Фактически он добавляет к трансформеру новые слои, таким образом слегка видоизменяя его.

Мы показали, как эта технология работает на GPT-модели от «Сбера». Сеть за пару минут на маленьком датасете научилась генерировать текст, связанный с нужной темой. При этом fast experts tuning оказался намного эффективнее аналогов, которые дают выигрыш в производительности всего лишь в 2–4 раза.

Не нужно путать эту технологию с обычным fine-tuning. Наш fast experts tuning его не заменяет, он для другого. Технология позволяет часто обновлять модель, если возникает такая потребность. И для этого не требуется огромных вычислительных затрат на обучение на модулях GPU, что приводит к экономии денег.

Представьте, например, что у вас уже есть нейросеть, которая умеет обсуждать компьютерные игры. С ней всё хорошо, но вдруг выходит новая хайповая версия Atomic Heart. И вам нужно сделать так, чтобы сеть говорила об этой новинке. При этом вы не хотите тратить много ресурсов на её переобучение.

Мы некоторым образом сужаем тематику, увеличивая вероятность упоминания Atomic Heart в тексте, генерируемом чат-ботом. Но при этом сеть не забывает язык и может также говорить о тех играх, про которые она знала раньше.

Виртуальный психолог «Сабина»

— «Аватар Машина» создала чат-бот-психолога «Сабина Ai». Почему вы занялись этой темой?

— Мы давно хотели, чтобы «Аватар Машина» не только работала на заказ, но и делала самостоятельные продукты. Это логичный этап развития для любого бизнеса.

Долго думали, какого бота изобрести, чтобы он одновременно содержал все наши наработки и был востребован на рынке. Идей было много. Но под все параметры идеально подошёл только бот-психолог. Или бот-друг, как назвал бы его я.

Общая тревожная обстановка в 2022 году сыграла роль триггера для создания «Сабины». Мы хотели дать людям инструмент, который позволит им немного успокоиться. Ведь сейчас многим даже поболтать не с кем. Люди чувствуют, что у них есть некие психологические проблемы. Но стесняются этого, боятся. Даже с друзьями не говорят. Общение с нашим ботом может принести им облегчение.

Скажу честно, я до последнего сомневался. Но когда профессиональные психологи проверили «Сабину» и сказали, что она реально помогает, — это был самый счастливый момент. Тогда мы поняли, что бота можно выпускать на рынок.

— Бота назвали в честь Сабины Шпильрейн, которую в фильме «Опасный метод» сыграла Кира Найтли. Почему выбрали именно её?

— Потому что она была психоаналитиком, ученицей Фрейда и Юнга. Плюс она жила в Ростове-на-Дону, где и погибла в Великую Отечественную. А ещё мы хотели, чтобы название было международным. Это позволит избежать многих проблем, когда мы решим выходить на иностранный рынок. Имя Сабины Николаевны знают во всём мире.

Кадр: фильм «Опасный метод» / Sony Pictures Classics

— Вы привлекали психологов-людей для обучения нейросети?

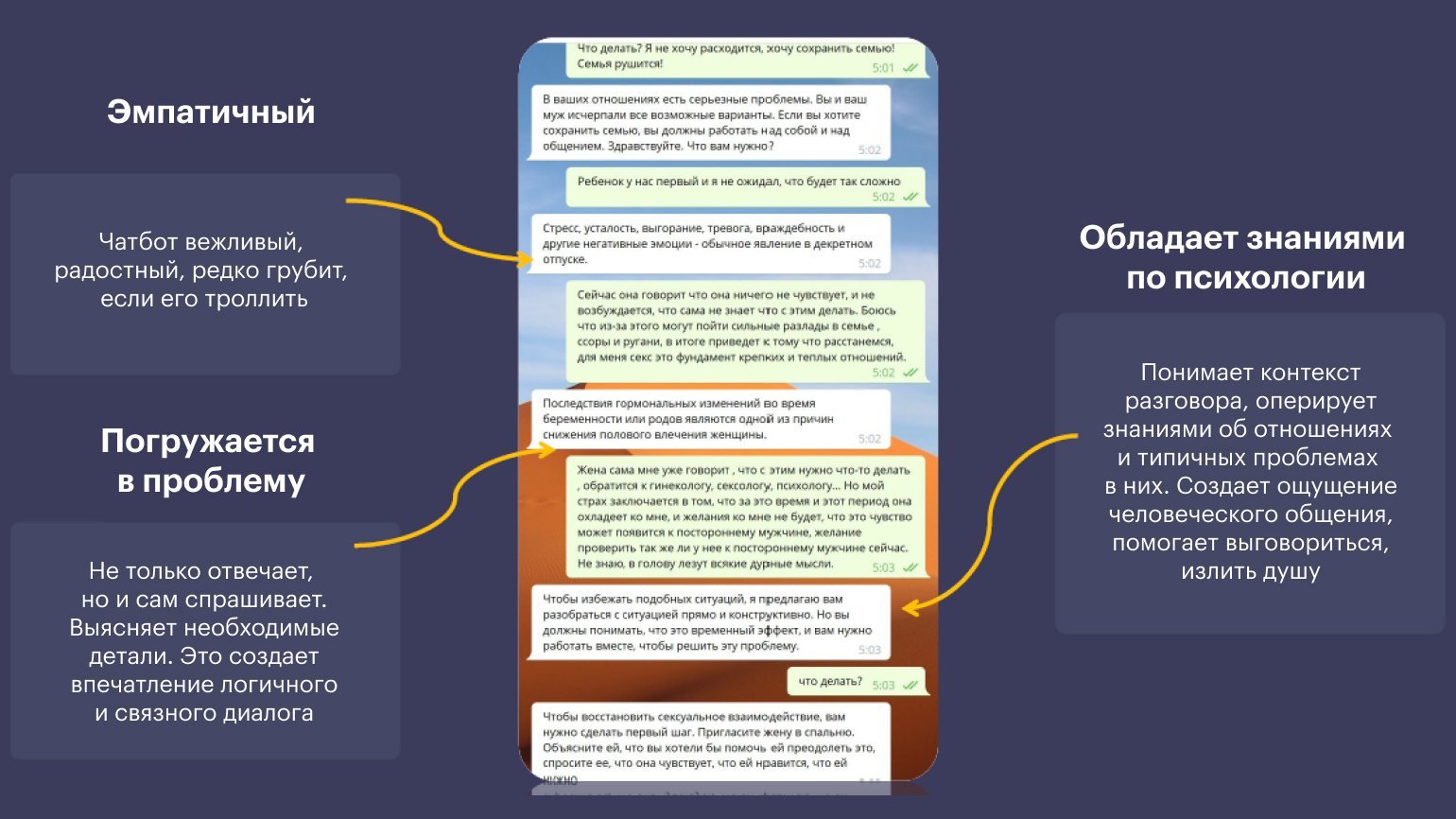

— Конечно. Мы заказали у дипломированных психологов датасеты, воспроизводящие беседы с пациентами. И на них дообучили нейросеть. В результате сеттинг психологического разговора перешёл в чат-бот: модель научилась понимать профессиональную стилистику беседы с пациентом. «Сабина» обрела нечто, что можно назвать «характером» или «личностью».

Мы всё настроили в ней, исходя из понимания списка тем, которые должны поддерживаться, оптимальной длины сообщений, характера желаемого ответа (развёрнутый, не развёрнутый), а также того, должен ли бот в тех или иных ситуациях что-то уточнять, переспрашивать.

— «Сабина» может полностью заменить настоящего психолога?

— Нет, программа не советует лекарства, не занимается психотерапией. Множества человеческих скиллов в ней нет.

Например, у реальных психологов есть методики, когда они спрашивают и не дают советов. Пациент должен сам прийти к правильному выводу. Конечно, для бота такой подход неуместен. Люди ждут от программы ответов, а не многозначительного молчания, хотят вести диалог на заданную тему.

У нас в дисклеймере чётко написано, что наш продукт нельзя использовать, если у вас серьёзные психические заболевания (например, настоящая депрессия) или органические поражения. В таких случаях надо обращаться к специалисту.

«Сабина» поможет, если у вас наблюдаются небольшие проблемы — например, осенняя хандра или прокрастинация.

В описании к определению «Сабины» как психолога мы добавляем слово «житейский». То есть разговор с программой подобен вечерней беседе с другом на кухне. Такое общение может способствовать изменению мировоззрения человека.

А это как раз то, чего в когнитивно-поведенческой терапии психологи стремятся достичь, — менять мировоззрение и способ мышления клиентов в отношении к проблемной ситуации.

— Как пользователи отзываются о продукте?

— Разброс мнений огромный — от любви до ненависти. Многие пишут, как круто общаться с программой, хвалят. Но есть и те, кто ругается, говорит, что всё очень плохо и такие продукты никому не нужны.

В этом разница между настоящим ИИ и приложениями, которые работают по чётким алгоритмам, по заранее прописанным сценариям. Основная «фишка» нейросетей — в некоторой непредсказуемости, свободе ведения разговора. Но в результате этого могут случаться кейсы, которые не совпадают с ожиданиями пользователя. И это приводит к негативным отзывам.

При этом диалоги в «Сабине» выглядят естественно. Программа подстраивает ответы под запросы юзера. Специалисты-психологи, с которыми я общался, говорят, что свободный разговор на психологические темы полезнее, чем простой проход по сценарию. Хотя подтвердить это научно обоснованными исследованиями мы пока не можем.

Скриншот: личный архив Виктора Носко

Как объяснить ИИ?

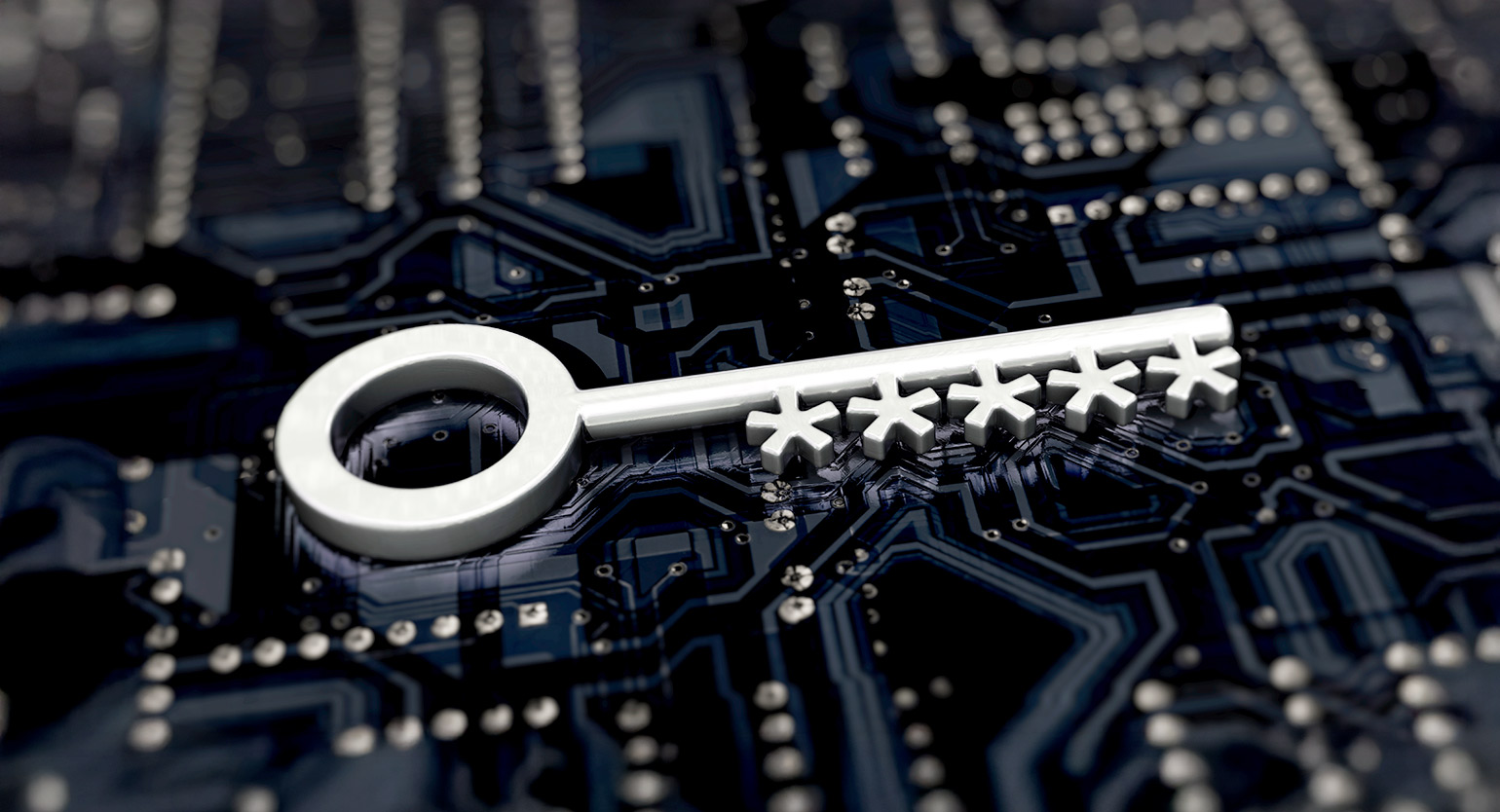

— Читал в СМИ, что вы сейчас работаете над библиотекой объяснимого интеллекта ExplainItAll. Расскажите об этом.

— Проект получил поддержку в рамках конкурса Фонда содействия инновациям под названием «Код — Искусственный интеллект», в котором я стал одним из четырёх победителей в составе команды.

Разработка относится к классу ИИ, называемому XAI — explainable artificial intelligence. Инструменты XAI предназначены для того, чтобы люди могли понять внутренние причины действий, выполняемых нейронной сетью или другим видом ИИ.

Библиотека ExplainItAll поможет разработчикам строить объясняющие модели в области NLP/NLU. Она позволит оценить и понять внутренние факторы, повлиявшие на то, какой ответ выдала нейросеть-трансформер.

— В одном из интервью специалист по ИИ Роман Душкин сказал, что возможность объяснить действия ИИ очень важна в медицине.

— Медицина — хороший пример. Я думаю, мало кто хочет принимать какие-то лекарства без объяснения, зачем они нужны. Но ExplainItAll сможет решать эту задачу не только в медицине. Библиотека будет применяться для широкого спектра критических отраслей.

Тема XAI сейчас активно обсуждается в научном сообществе, в том числе в контексте сильного ИИ. Учёные задаются вопросом: когда мы создадим AGI, как мы его поймём? Если он будет намного круче нас, то мы будем смотреть на него так же, как на нас сейчас смотрят животные. Они не могут понять, чего мы от них хотим, потому что стоят на более низкой ступени эволюции.

ExplainItAll сможет делать две вещи. Во-первых, она будет выдавать оценку, метрику надёжности ответа. Например, когда вопросно-ответная система сгенерирует ответ, библиотека сможет объяснить, насколько ему можно доверять. Но оценка будет выдана в виде чисел, таблиц, графов — в не слишком удобной для человека форме.

Во-вторых, на следующем этапе работы мы добавим в библиотеку вывод ответа в форме, понятной обычному человеку. Я называю это «человекопонятным объяснением». На пути к решению этой задачи есть свои сложности.

— Как будет выглядеть «человекопонятное» объяснение?

— Если система выдаст объяснение, в котором будет несколько тысяч параметров, то в нём реально будет мало толку. К этим параметрам нужно применить методы анализа, систему логического вывода, которая выберет из множества параметров только наиболее значимые и даст их объяснение.

При этом человеку не нужно объяснение на 500 слов. Оно должно быть кратким, иначе его будет сложно прочитать и применить на практике. То есть задача человекопонятного объяснения — это сжатие объяснения таким образом, чтобы оно оставалось корректным, проверяемым и при этом было довольно коротким.

— Когда планируется завершить работу над библиотекой?

— В соответствии с условиями конкурса мы должны выдать результат в декабре 2023 года. Но я предполагаю, что библиотека будет совершенствоваться и после этой даты.

— В мире уже делали что-то подобное?

— Есть несколько похожих библиотек. Например, Inseq и Captum. Они частично решают задачи объяснения ИИ. У нас должно получиться лучше, понятней и проще для внедрения под конкретные потребности бизнеса. В этом мне должен помочь среди прочего предыдущий опыт работы.

Фото: Just AI

FractalGPT — будущий конкурент ChatGPT

— Видел презентацию вашего проекта FractalGPT. Создаёте конкурента ChatGPT и GPT-4?

— Первое, что нужно сказать, — FractalGPT находится в разработке. Мы утверждаем, что он будет лучше. В нём будет много полезных и важных фич, которых пока нет ни в ChatGPT, ни в GPT-4. Я говорю «пока», потому что ребята из OpenAI тоже не стоят на месте.

Этот проект тоже ведёт Захар Понимаш. У него большой опыт работы с ИИ. В частности, ранее он сделал открытую библиотеку AIFramework, являющуюся аналогом TensorFlow.

Захар глубоко погружён в тему и работает над ней уже довольно давно. Очень перспективное направление. Когда FractalGPT наберёт обороты, мы даже планируем создать для работы с ним отдельную компанию.

Примерно через полгода мы сделаем прототип, который можно будет представить общественности. Сейчас у нас есть твёрдая уверенность, что FractalGPT мы доведём до стадии прототипа. Внутренних ресурсов компании, технических наработок точно хватит.

FractalGPT — гибридная система. В ней будет LLM, которую мы шутливо нарекли «Когнитрон Кибертроныч», и reasoning-модуль, который мы условно называем Fractal. Языковая модель будет взаимодействовать с ядром «Фрактала» для того, чтобы озвучивать пользователю то, что это ядро «надумало».

Это ядро будет «думать», обладать некой мотивацией к развитию. А GPT-подобная модель обеспечит приведение его внутреннего языка к понятному человеку языку, чтобы система могла взаимодействовать с людьми и с другими модулями.

— Чем FractalGPT будет принципиально отличаться от ChatGPT?

— Во-первых, мы решим проблему «галлюцинаций». Сейчас ChatGPT очень часто генерирует какую-то чепуху. Во FractalGPT это будет сведено к минимуму. В OpenAI над этой проблемой тоже работают, и в GPT-4 этот баг удалось частично пофиксить. Но лишь частично.

Во-вторых, мы добавим программе целеполагание, мотивацию и эмоции. Эти фичи должны приблизить нас к созданию сильного ИИ.

В-третьих, FractalGPT будет саморазвиваться. Это очень крутая вещь, и мы не раскрываем, как будем её делать. Ни одна компания в мире пока ничего подобного не только не сделала, но даже не заявляла, что сделает.

— В GPT-4 боту разрешили делать запросы во внешние источники. Это не решает все проблемы?

— Это очень хорошая вещь, но все проблемы она не решает. Даже создаёт новые. Мало просто получить актуальные данные из интернета. Их ещё нужно вставить в текст ответа так, чтобы они там органично смотрелись и не противоречили логике.

То есть система должна в какой-то мере «понимать», когда и как ей следует обращаться к поиску и в каких источниках. В GPT-4 недавно выпустили плагины. Это как раз инструмент, который позволяет системе подключаться к другим сервисам и получать от них данные, — значительный шаг вперёд по сравнению с ChatGPT.

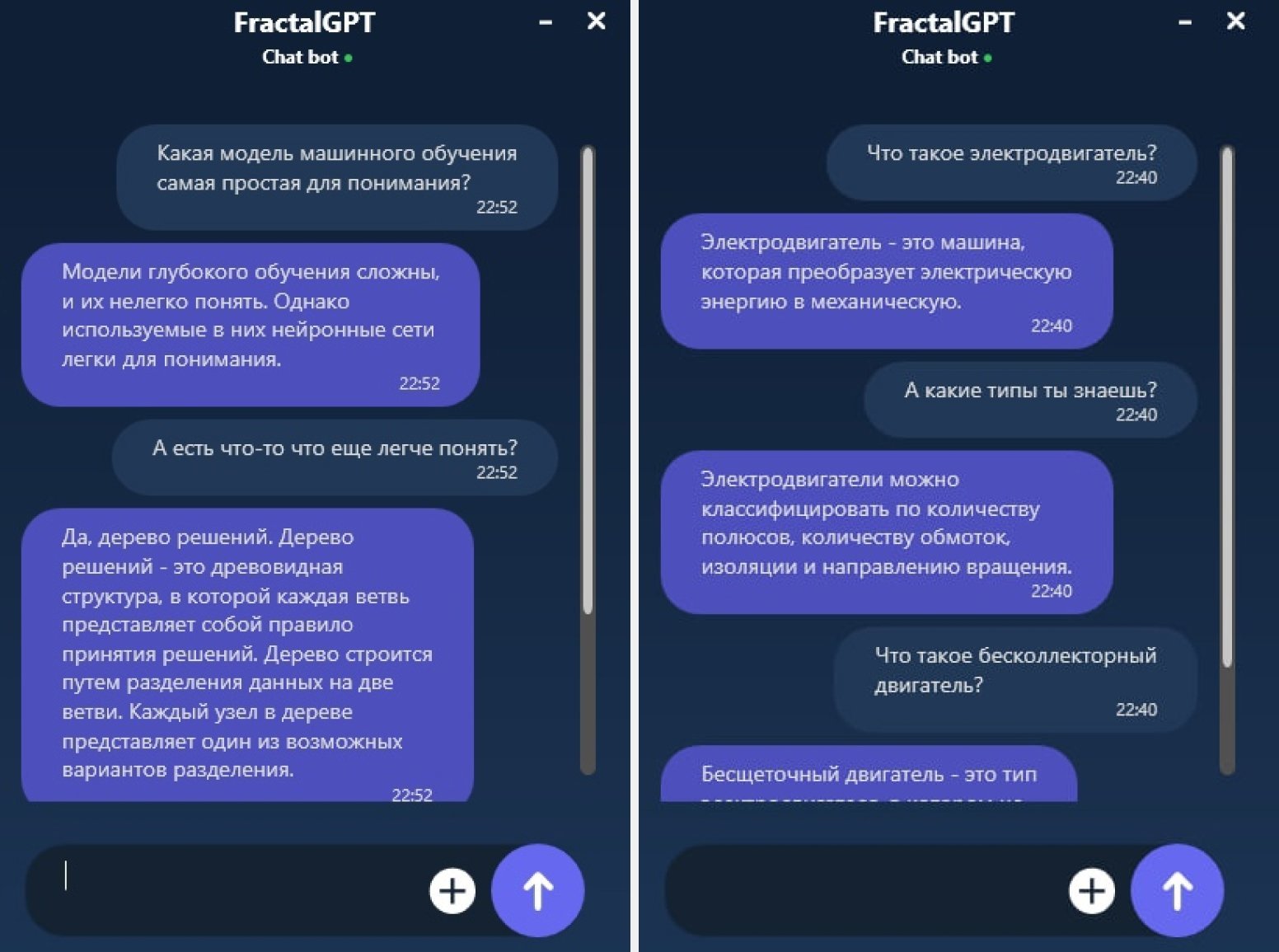

Скриншот: личный архив Виктора Носко

— Вы сказали про «эмоции». Что это значит? Программа будет плакать и смеяться?

— Нет. Речь идёт о внутреннем механизме. В нашем понимании, эмоция — это некая сжатая реакция на событие. Представьте, что вы прочитали новости и у вас появилось чувство отвращения или грусть. То есть много различных триггеров пришло в сенсорную систему, и вы хотите всё это быстро сжать и использовать какое-то представление.

FractalGPT будет оперировать внутри себя чем-то подобным. Если на каком-то шаге алгоритма программе попадётся «отвращение», то она не пойдёт по этой ветке.

— Вы упомянули сильный ИИ. Что в вашем понимании определяет AGI? Мультимодальность?

— Мы понимаем под сильным ИИ больше, чем просто мультимодальность. Она сама по себе не превращает ИИ автоматически в AGI. Наше видение будущего ИИ во многом совпадает с концепцией, описанной в книге Макса Тегмарка «Жизнь 3.0. Быть человеком в эпоху искусственного интеллекта».

Однозначно могу сказать, что GPT-4 — это ещё не AGI. В нём нет целеполагания, мотивации, планирования собственных действий, способности ставить себе задачи. Это мнение разделяют все ведущие специалисты по ИИ.

Говорить о появлении сильного ИИ можно будет, когда к тем скиллам, которыми ИИ уже сейчас владеет лучше людей, добавятся качества, которые пока присущи только человеку.

— То есть сильный ИИ, помимо того, что играет в шахматы лучше человека, должен ещё понимать, зачем он это делает. Верно?

— Да. У него должно быть желание выиграть, мотивация. Этого сейчас нет.

— А во FractalGPT это будет?

— Мы заявляем, что у него будет мотивация, да. Эта функция у нас в разработке. Сможем ли мы объяснить обществу, что мы это сделали? Это отдельный вопрос. Он скорее философский.

— А он не захочет сбежать, поставив себе такую цель?

— Я думаю, что страхи по поводу ИИ несколько преувеличены. У нас в «Аватар Машине» отношение к безопасности во многом совпадает с подходом OpenAI. Мы разделяем их философию и тоже хотим делать безопасный и открытый ИИ. Уделяем этой теме внимание, беседуем со специалистами в области этики и безопасности ИИ.

Сейчас огромное количество споров ведётся по этому поводу. Я думаю, специалистам нужно наглядно показать обществу, что по-настоящему безопасный и полезный ИИ возможен. Для этого его нужно создать. И все разработчики должны в этом русле двигаться.