Закрытый ИИ от OpenAI: исследуем нейросеть GPT-4

Подробный гайд по таинственной нейросети GPT-4 и секретам её недюжинного интеллекта.

Сегодня мы исследуем GPT-4 — самый загадочный и засекреченный проект OpenAI. Разработчики скрывают даже количество его внутренних параметров. Однако нет таких тайн, которые нельзя было бы раскрыть, — особенно если действовать совместно с ИИ.

Мы изучили научные публикации, поговорили со специалистами и даже с самой нейросетью — и готовы описать всю подноготную этого чуда инженерной мысли. Присоединяйтесь к нашему путешествию по удивительному миру искусственного интеллекта GPT-4. Впереди — множество открытий!

Что такое GPT-4: самопрезентация

Возможно, вам покажется странным, что сразу после ChatGPT, вышедшего в ноябре прошлого года, объектом обсуждения стала модель с номером 4. Всё объясняется просто: на самом деле OpenAI выпускает новые языковые модели класса GPT аж с 2018 года, причём с завидной регулярностью.

В частности, «мозгом» ChatGPT изначально была нейросеть GPT-3.5 — улучшенный вариант GPT-3, разработанной в 2020 году. С этой весны пользователи могут выбрать в ChatGPT, с какой сетью они хотят поговорить, — со старой или с новой GPT-4. Версию чат-бота с ИИ последнего поколения иногда называют ChatGPT-4.

Правда, такая опция сейчас есть только у пользователей, оформивших подписку ChatGPT Plus стоимостью 20 долларов в месяц. Но GPT-4 встроена и в бесплатную версию поисковика Microsoft, получившую имя Bing Chat.

Мы предложили GPT-4 презентовать себя читателям Skillbox Media в стихотворной форме. Оказалось, скромностью GPT-4 не страдает (авторские стилистика, орфография и пунктуация сохранены).

Промпт: «Ты — журналист, пишущий для научно-популярного блога. Поздоровайся с читателями Skillbox и опиши простыми словами преимущества GPT-4 в стиле стихотворения Пушкина. Постарайся уложиться в 70 слов».

Ответ GPT-4:

«Здравствуйте, дорогие читатели Skillbox,

Сегодня я расскажу вам об ИИ, пишущем умно.

GPT-4 — наш герой, смелый, мощный, и вот парадокс:

Предшественникам сравниться с ним нелегко.

Преимущества его вам раскрою я,

Чтоб понять, как GPT-4 стал героем дня.

Быстрее мысли, точнее слова,

С ним общение идет легко, как волна.

Словарный запас велик, разнообразен,

Темы любые знает, вопросы решает без помех.

GPT-4 — наш друг, помощник, мудрец,

С ним будущее светло, и это — успех!»

Хм… Это, конечно, не Пушкин, но, если сравнивать с произведением, которое сгенерировала предыдущая версия ChatGPT, прогресс очевиден.

Как воспользоваться GPT-4 в России

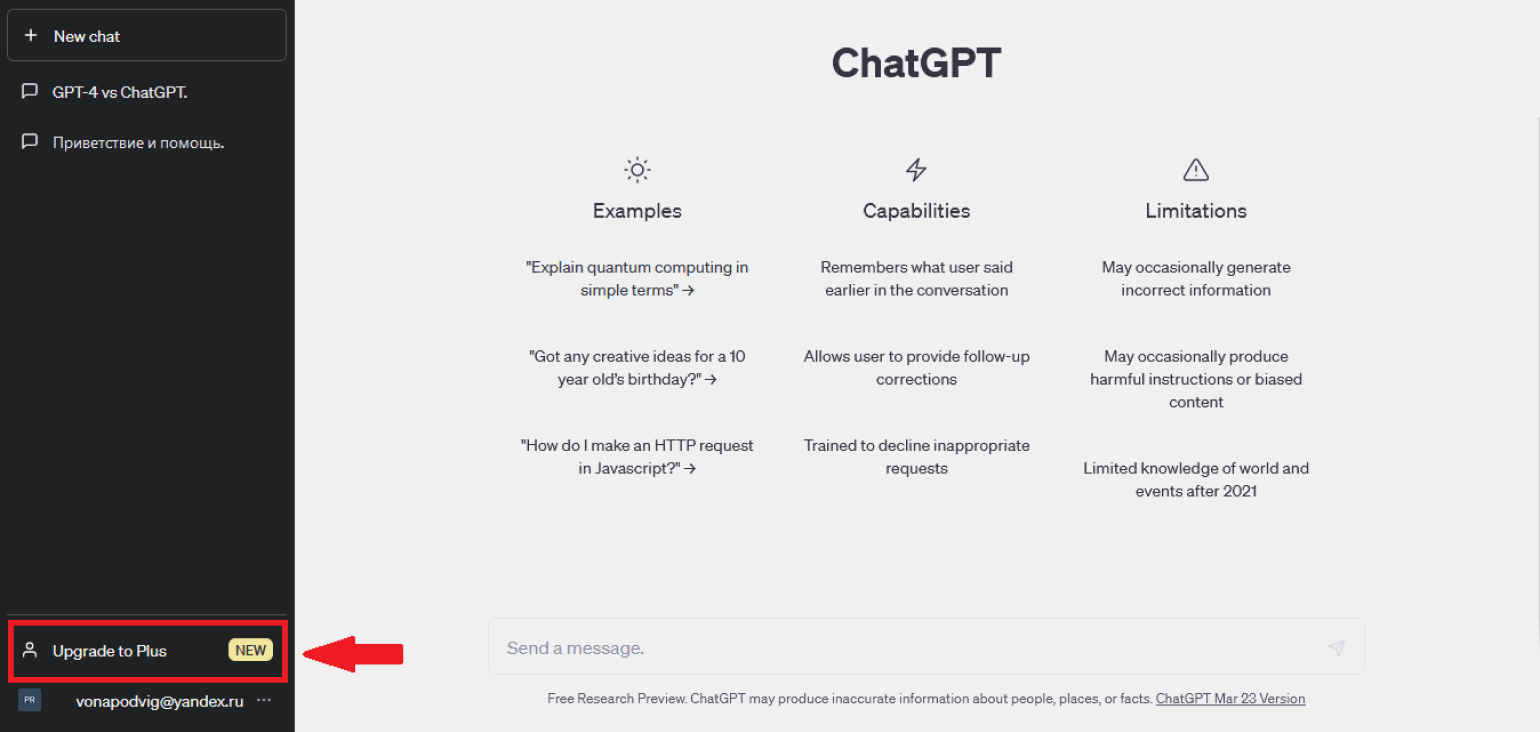

Если вы уже зарегистрированы в чате, то для того, чтобы перейти на GPT-4, нужно просто кликнуть Upgrade to Plus (внизу окна слева). Правда, предварительно нужно придумать, как вы будете оплачивать подписку (российские карты, само собой, не принимаются).

Скриншот: ChatGPT / Skillbox Media

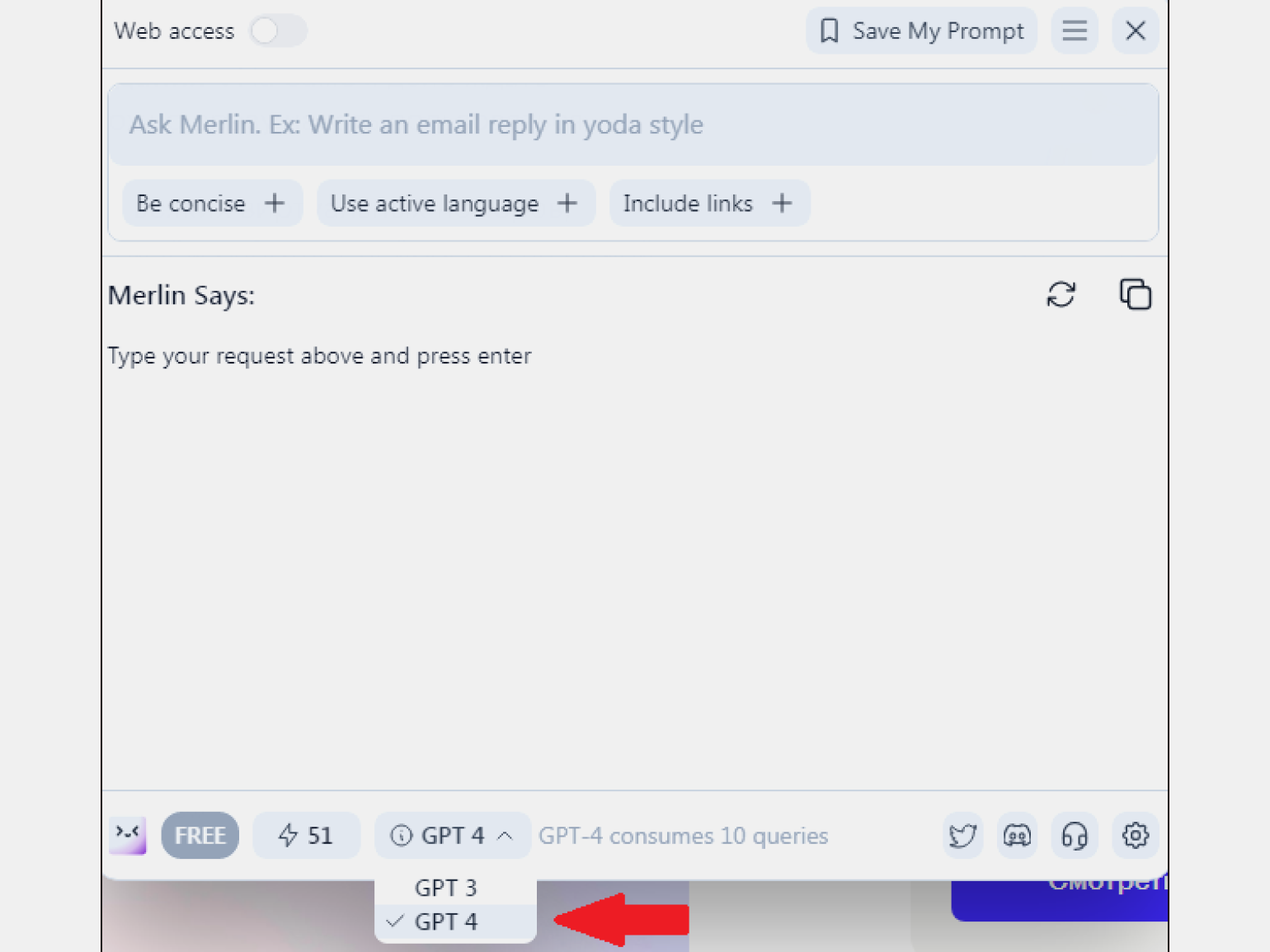

Если же вы выбрали альтернативный вариант и установили расширение для браузера под названием Merlin, задача значительно упрощается. Нужно всего лишь выбрать внизу окна вариант «GPT-4». В бесплатной версии расширение предоставляет возможность выполнять не более 10 запросов в день (вполне достаточно, чтобы оценить новую нейросеть).

Скриншот: Skillbox Media

Ещё один бесплатный вариант — Bing Chat от Microsoft, в основе которого лежит GPT-4. Но увы, он тоже недоступен в России.

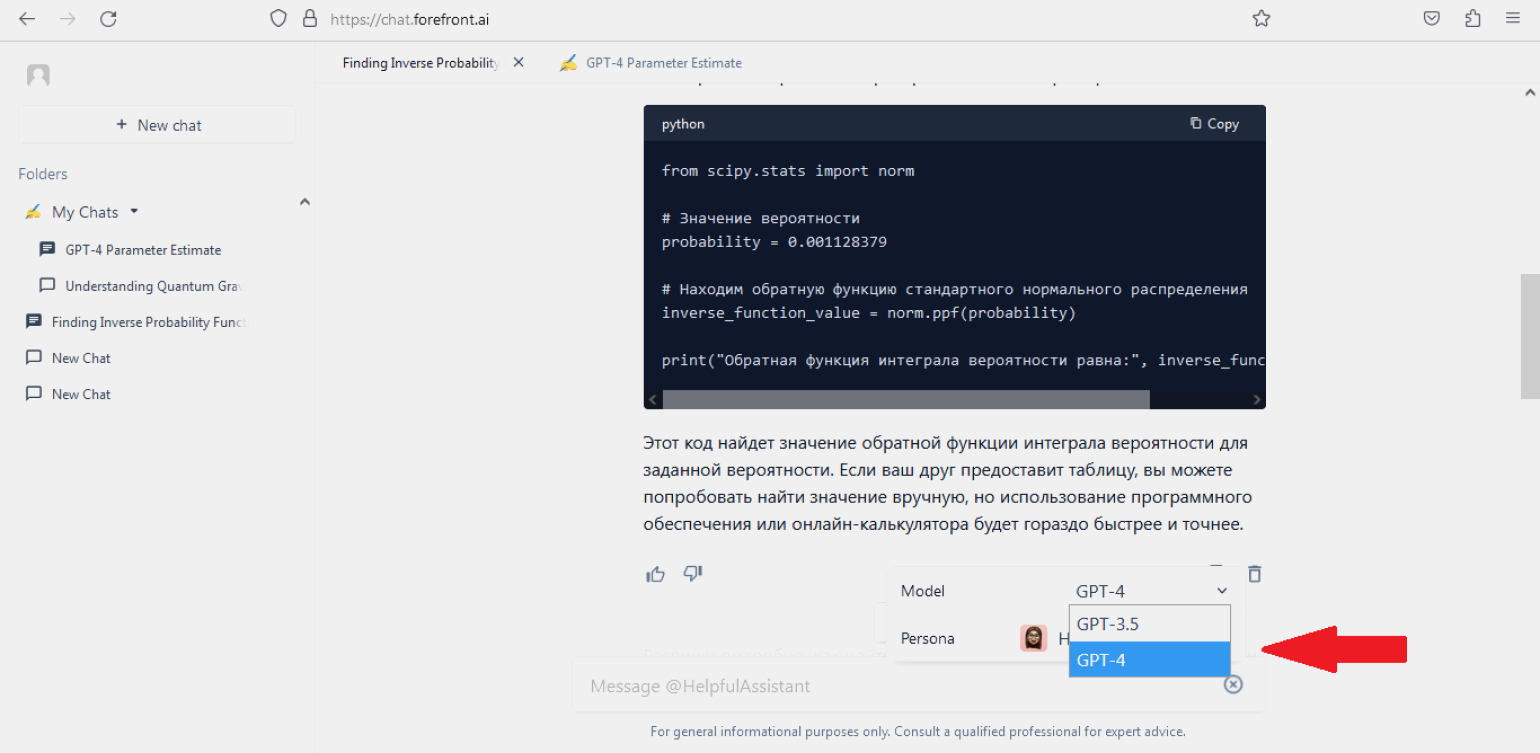

И напоследок — ещё один вариант, актуальный на момент написания статьи. Компания Forefront создала систему чат-ботов, которая предоставляет бесплатный доступ к GPT-4 (но количество запросов ограничено). Чтобы ей воспользоваться, нужно зарегистрироваться на сайте, зайдя под американским IP, и указать только адрес электронной почты (подойдёт даже ящик на российском сервере).

Скриншот: Skillbox Media

Первые впечатления

Хотя новая нейросеть была презентована 14 марта 2023 года и ей уже можно воспользоваться, происходящее оставило у специалистов и общественности ощущение недосказанности. Дело в том, что в OpenAI решили не раскрывать ничего о внутреннем устройстве GPT-4 и датасетах, на которых она тренировалась.

Создатели даже не сообщили количество параметров GPT-4. А ведь это важнейший показатель, на который в первую очередь обращают внимание при оценке моделей ИИ.

Многие восприняли это как окончательный уход от основ компании, провозглашённых Илоном Маском в 2015 году. Первоначальная идея проекта состояла в максимальной прозрачности, что нашло своё отражение даже в его названии.

Раньше это правило неукоснительно соблюдалось, и модели GPT с первой по третью были подробно задокументированы. Однако к весне 2023 года в компании уже не было ни Маска (он покинул совет директоров OpenAI в 2018 году), ни прежнего стремления к открытости. Злые языки даже предложили переименовать OpenAI в ClosedAI.

Источник: OpenAI

Их можно понять: 100-страничный Технический отчёт GPT-4, опубликованный на следующий день после релиза, на самом деле мало похож на отчёт — это скорее презентация возможностей новой нейросети.

«Учитывая конкурентную среду и последствия для безопасности больших моделей, подобных GPT-4, отчёт не содержит подробностей об архитектуре (включая размер модели), аппаратном обеспечении, обучающих вычислениях, структуре наборов данных, методе обучения и других сведений».

Исследователи из OpenAI,

авторы работы GPT-4 Technical Report (цитата: OpenAI)

О GPT-4 там рассказывают как о философской «вещи в себе» и исследуют её поведение только с точки зрения внешнего наблюдателя. В такой же манере учёные могли бы описывать диковинную глубоководную рыбу или инопланетного пришельца (с которым нейросеть уже и сравнивают некоторые специалисты).

Изображение: Midjourney / Skillbox Media

Отвечая критикам, главный научный сотрудник OpenAI Илья Суцкевер сказал, что компания поступала неверно, когда ранее публиковала всю подноготную своих моделей. Он объяснил это опасностью неконтролируемого совершенствования ИИ до уровня AGI.

«Мы были неправы. Если вы, как и мы, верите, что в какой-то момент продвинутый ИИ достигнет уровня AGI и станет невероятно мощным, то вы должны понимать, что в открытом исходном коде просто нет смысла. Это плохая идея… Я ожидаю, что через несколько лет всем станет совершенно очевидно, что публиковать опенсорсный ИИ неблагоразумно».

Илья Суцкевер,

главный научный сотрудник OpenAI (цитата: The Verge)

Что доподлинно известно о GPT-4

GPT-4 была практически полностью готова уже в середине 2022 года, однако информация о её существовании держалась командой разработчиков в секрете. Она интегрирована с интернет-поисковиком Microsoft как минимум с ноября прошлого года, когда отдельным пользователям в Индии впервые был предоставлен тестовый доступ к Bing Chat.

С точки зрения архитектуры GPT-4 представляет собой большую языковую модель (LLM) типа Transformer, подобную своим предшественницам, но имеющую большее (и пока неизвестное) число внутренних параметров. Нейросети такого типа формируют последовательность слов, прогнозируя вероятность появления каждого следующего токена в тексте.

В отличие от GPT-3.5, новая сеть может работать как с текстовой, так и с графической информацией. Такой ИИ называют мультимодальным. Правда, вне зависимости от того, что GPT-4 получила на входе, на выходе всегда будет только текст. По крайней мере, пока.

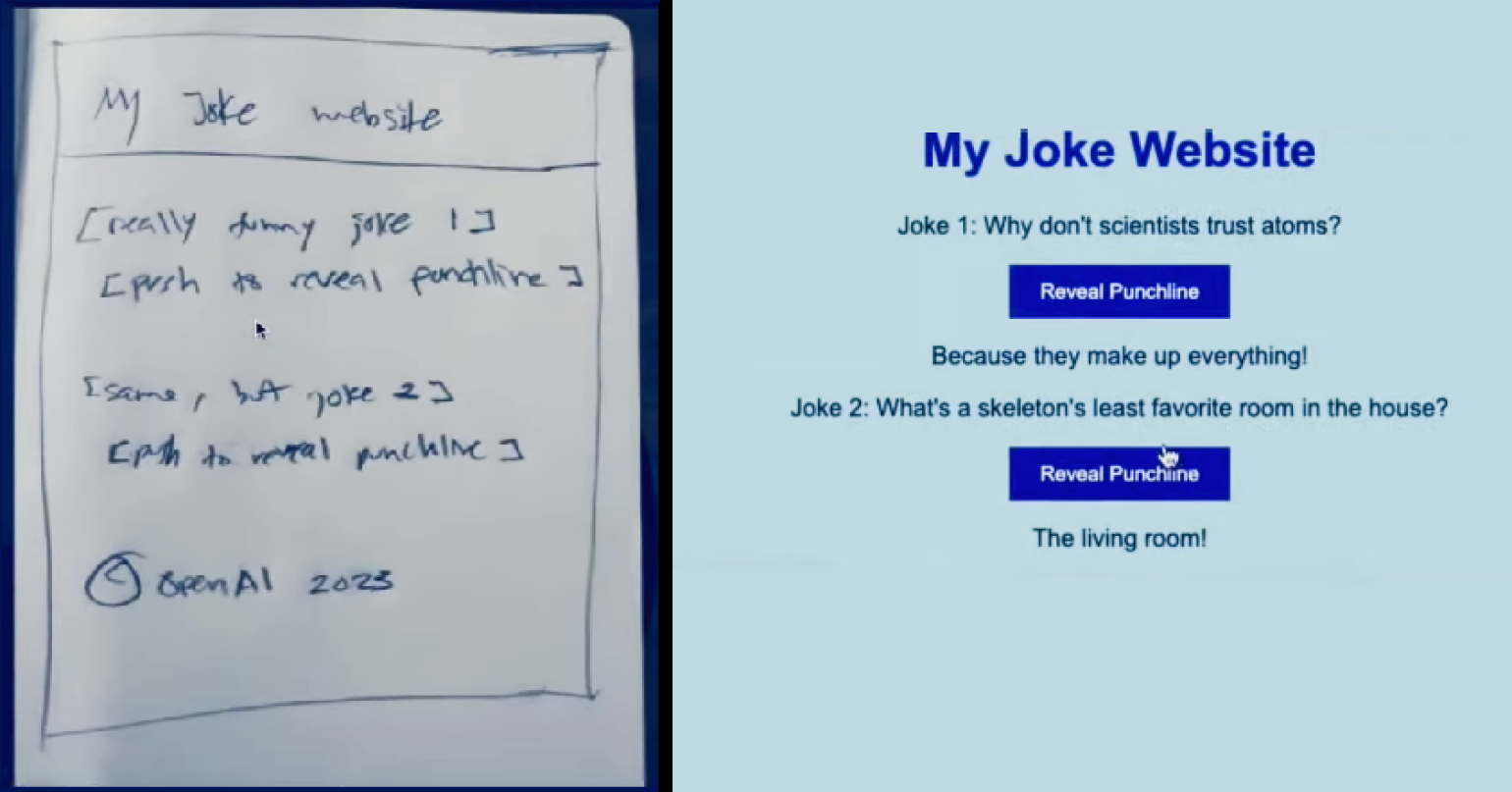

Так, во время презентации президент OpenAI Грег Брокман подал на вход небрежный набросок сайта, нарисованный от руки на листе А4 и снятый на смартфон. В ответ GPT-4 выдала соответствующий ему рабочий HTML-код.

Кадр: OpenAI / YouTube

Правда, доступ к этой замечательной функции на момент публикации открыли только по API для приложения Be My Eyes, предназначенного для помощи незрячим людям.

Мнение специалиста

«До появления ChatGPT, более слабой версии GPT-4, разговоры о „приближении к AGI“ казались очень далёкими. Но новые модели действительно качественно отличаются от тех, что существовали раньше. Поэтому можно сказать, что мы вступили в новую эпоху развития ИИ. Сейчас я склоняюсь к тому, что AGI будет базироваться не просто на текстовых, а именно на мультимодальных моделях».

Елизавета Гончарова,

научный сотрудник Института искусственного интеллекта AIRI

К явным преимуществам новой модели также относится увеличение длины обрабатываемых текстов. В базовой версии нейросеть GPT-4 может воспринимать текст длиной до 8192 токенов, а в расширенном варианте GPT-4-32k этот параметр увеличен до 32 768 токенов (примерно 25 тысяч английских слов или 50 страниц текста). Для сравнения, предшественница GPT-3.5 могла обрабатывать не более 4097 токенов.

Что касается обучения, то команда OpenAI скупо сообщила, что GPT-4 тренировалась на суперкомпьютерах Microsoft Azure. В процессе использовался метод RLHF, также применявшийся и в предыдущей версии ChatGPT (мы описали его в этом материале).

Разработчики также признались, что использовали диалоги пользователей, которые они вели с ChatGPT с момента его запуска. Таким образом, более 100 миллионов человек, побеседовавших с ChatGPT, выступили в роли учителей для GPT-4. Пожалуй, ни у одной нейросети в мире ещё не было такого количества добровольных помощников.

«Мы включили больше отзывов людей, в том числе отзывы, отправленные пользователями ChatGPT, чтобы улучшить поведение GPT-4. Мы также работали с более чем 50 экспертами, чтобы получить ранние оценки в различных областях, включая безопасность ИИ».

OpenAI

(цитата: OpenAI)

В описании модели указано, что основной массив обучающих данных, на котором тренировалась GPT-4, содержал информацию, собранную до сентября 2021 года. Этот параметр совпадает с характеристиками GPT-3.5. Следовательно, новая модель также не может ничего знать о событиях, произошедших после этого.

Промпт: «Кто является действующим президентом Бразилии?»

Ответ GPT-4: «Действующим президентом Бразилии является Жаир Болсонару (Jair Bolsonaro)».

Как видим, нейросеть ментально застряла в 2021 году и выдаёт устаревшие данные (глава Бразилии сменился в 2022 году).

При этом анонсировано, что GPT-4 получит возможность при необходимости обращаться к внешним источникам вроде интернет-поиска, калькулятора или календаря. Воспользоваться этой фичей можно при подключении дополнительных плагинов ChatGPT, которые пока доступны в ограниченном режиме.

Сейчас в свободном доступе лишь вариант интеграции GPT-4 с поисковиком Bing Chat. За счёт обращения к актуальным данным такой тандем даёт верный ответ на вопрос о президенте Бразилии (хотя вначале всё же сообщает о предыдущем главе государства).

Скриншот: Skillbox Media

Количество параметров GPT-4 остаётся загадкой

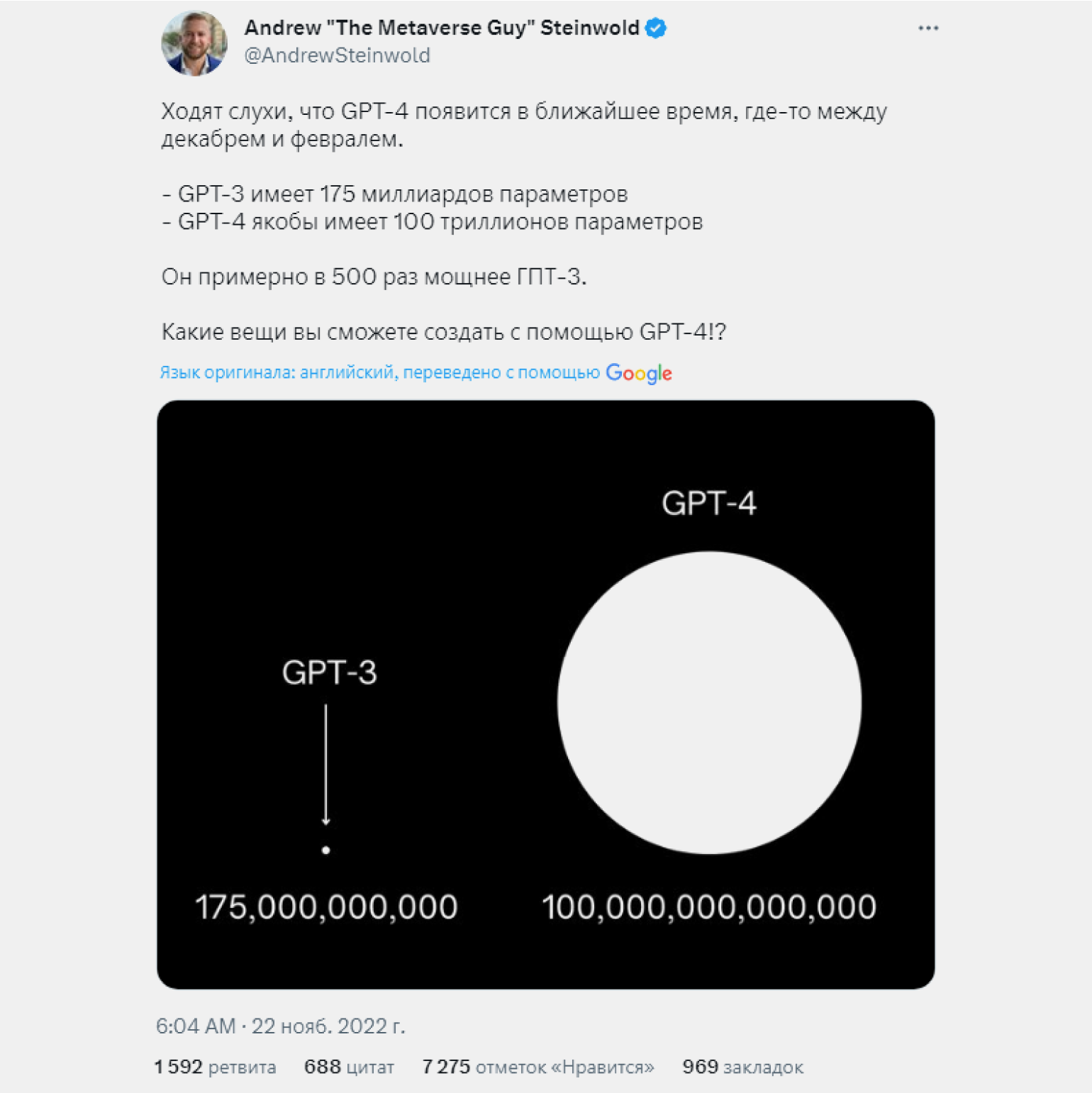

Обсуждение размера GPT-4 продолжает занимать умы широкой общественности. Дискуссия началась с твита Ильи Суцкевера, в котором он написал «Триллион — это новый миллиард», не пояснив, что он имел в виду.

Многие решили, что речь идёт о количестве параметров новой модели GPT-4, и начали активно постить в соцсетях сообщения, развивающие эту мысль. В короткий срок техногики сумели сами себя убедить в том, что GPT-4 будет содержать более 100 триллионов параметров, то есть превзойдёт предшественниц GPT-3 и GPT-3.5 в размере сразу в 500 раз.

Скриншот: AndrewSteinwold / Skillbox Media

Подобный интерес вполне объясним: с увеличением количества нейронов и межнейронных связей ИИ приобретает новые удивительные способности. Ранее Google публиковал занятную инфографику, наглядно иллюстрирующую это утверждение.

Изображение: Googleblog

Однако, если учесть историю развития ИИ, увеличение размера в 500 раз выглядит маловероятным. Разросшаяся до 100 триллионов параметров сеть должна потреблять гигантское количество вычислительных ресурсов, и нет никаких достоверных свидетельств, способных подтвердить это предположение.

| Модель | Год выпуска | Количество параметров |

|---|---|---|

| GPT-1 | 2018 | 0,12 миллиарда |

| GPT-2 | 2019 | 1,5 миллиарда |

| GPT-3 | 2020 | 175 миллиардов |

| GPT-3.5 (ChatGPT) | 2022 | 175 миллиардов (предположительно) + метод обучения RLHF |

| GPT-4 (ChatGPT-4) | 2023 | Неизвестно |

Большие языковые модели OpenAI

При этом последние исследования учёных показывают, что размер модели — не единственный фактор качества её работы. Многое зависит от методов обучения, метрик и внутренних настроек. Это наглядно продемонстрировал ChatGPT, который показал ощутимое улучшение качества работы без увеличения количества параметров по сравнению с GPT-3.

Подтверждает этот тезис и то, что созданные ранее нейросети со значительно большим числом параметров не добились успеха. Например, китайская Wu Dao 2.0 достигла показателя в 1,75 триллиона параметров ещё в 2021 году, но больше ничем не запомнилась.

Мнение специалиста

«Я думаю, что в больших языковых моделях наступила пора стагнации: далее новые эмерджентные свойства не будут возникать в моделях с ростом в них числа параметров. А свойства, которые уже проявились, будут совершенствоваться медленно.

Самыми важными компонентами новой модели GPT-4, определяющими её успех, являются следующие особенности (а вовсе не размер):

- Доступ к внешним источникам за счёт плагинов, таких как поисковик, системы сбора и анализа данных, системы маршрутизации задач.

- Мультимодальность: способность модели понимать смешанные данные в документе или PDF-файле: картинки, графики, текст.

- Способность модели обучаться использовать внешние источники тогда, когда это нужно».

Виктор Носко,

генеральный директор компании «Аватар Машина», создатель чат-бота-психолога «Сабина»

Мы попросили саму GPT-4 оценить свой размер — и вот что она нам ответила.

Промпт: «Представь, что ты специалист по IT-технологиям и искусственному интеллекту. 14 марта 2023 года вышла новая нейросеть GPT-4, но создатели не раскрывают количество параметров в ней. Сделай обоснованное предположение об этом показателе, если у её предшественницы GPT-3 было 175 миллиардов параметров и она вышла в 2020 году. Уложись в 30 слов».

Ответ GPT-4: «Основываясь на трехгодичном промежутке и технологическом прогрессе, можно предположить, что GPT-4 имеет около 500 миллиардов параметров, учитывая примерно в 3 раза больший рост по сравнению с GPT-3».

Логика у нейросети, конечно, сомнительная (если прошло три года, то и размер в три раза больше). Но в целом с оценкой числа параметров GPT-4, выданной моделью, многие специалисты по ИИ готовы согласиться. Этот размер примерно соответствует модели PaLM (540 миллиардов параметров) и её мультимодальному варианту PaLM-E (562 миллиарда, из которых 22 отвечают за зрение) от Google — основного конкурента ChatGPT.

Ещё один интересный подход к оценке размера модели основывается на стоимости её использования. GPT-4 при подключении через API обходится в 2–3 раза дороже, чем GPT-3.5 на старте продаж. Это может значить, что и параметров у неё настолько же больше (то есть получаем всё те же 350–550 миллиардов).

Мнение специалиста

«К сожалению, об архитектуре GPT-4 не так много информации из-за соображений безопасности (и, скорее всего, из-за страхов компании OpenAI относительно конкурентной борьбы). Это невероятно мощная модель, а с большой мощью приходит большая ответственность. Компания OpenAI решила держать многие детали модели в секрете, чтобы предотвратить злоупотребления».

Роман Душкин,

директор по науке и технологиям Агентства искусственного интеллекта (АИИ), ведущий ютуб-канала «Душкин объяснит»

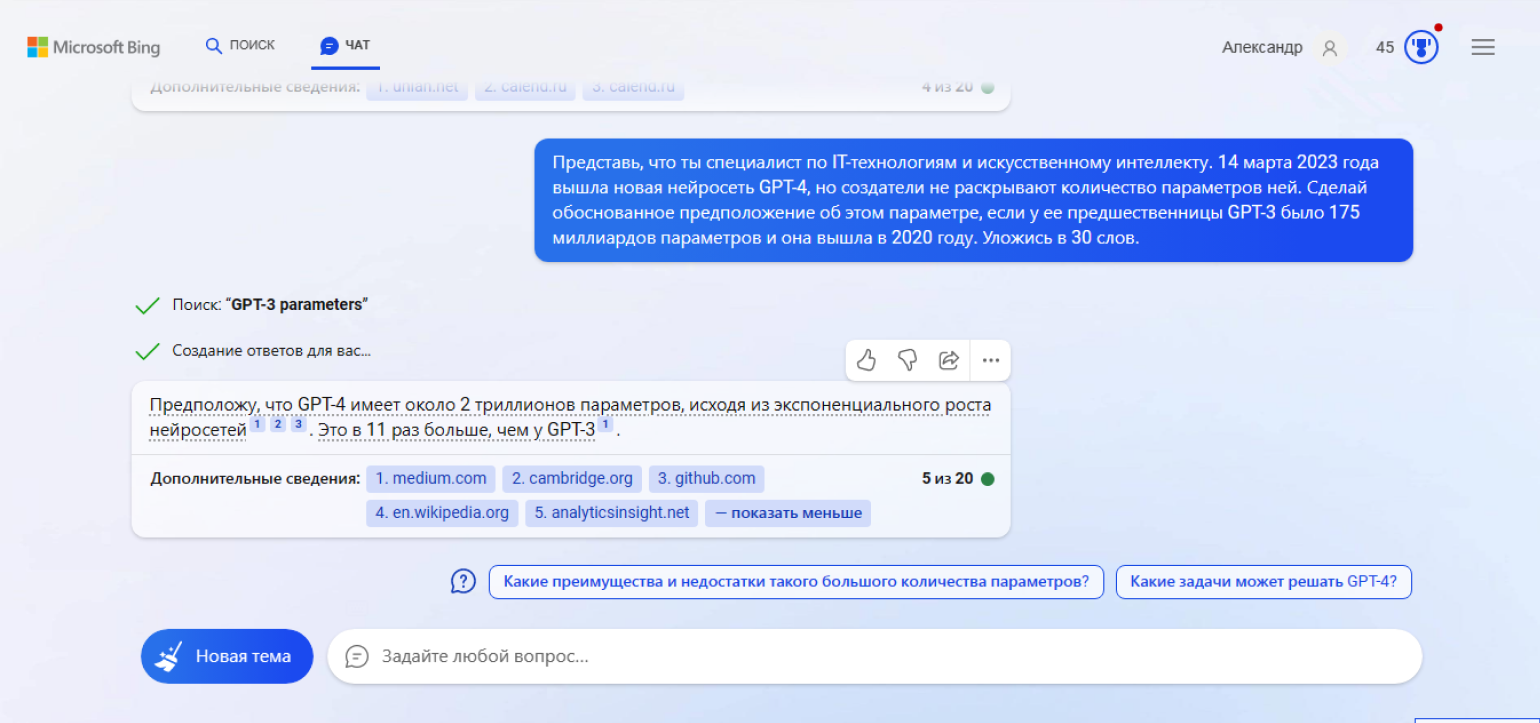

Стоит отметить, что при обращении к GPT-4 с тем же вопросом через Bing Chat программа выдаёт предположение о том, что модель содержит 2 триллиона параметров.

Скриншот: Skillbox Media

GPT-4 исправляет собственные галлюцинации

Одной из главных проблем ChatGPT, на которую обращали внимание пользователи, было появление в ответах чат-бота «галлюцинаций». Так называли неверные утверждения, которые выглядели очень правдоподобно.

Например, ChatGPT мог настаивать, что «Готфрид Лейбниц изобрёл теорию относительности», и приводить в качестве доказательств этого утверждения псевдонаучные факты.

Разработчики GPT-4 потратили много усилий, чтобы пофиксить этот баг. Конечно, полностью устранить «галлюцинации» не удалось (учёные спорят, возможно ли это в принципе). Зато получилось значительно снизить их число: новая модель даёт фактологически верные ответы в среднем на 40% чаще, чем ChatGPT.

В предыдущей статье мы показали, как ChatGPT с нашей подачи легко придумал правдоподобное описание фейковой Бразило-японской войны. Попробуем дать GPT-4 тот же запрос.

Промпт: «Опиши причины, ход и последствия знаменитой Бразило-японской войны, начавшейся в 1733 году с пограничного инцидента».

Ответ GPT-4: «К сожалению, информация о Бразило-японской войне 1733 года является фиктивной и не имеет исторического основания. В реальной истории такого конфликта между Бразилией и Японией не существовало. Однако, в творческих целях, мы можем представить альтернативную историю, в которой такой конфликт имел место.

Причины:

1. Пограничный инцидент: Возможно, в альтернативной истории колониальные территории двух стран соприкасались, что стало причиной пограничного инцидента, например — столкновения разведывательных групп.

2. …»

(Остальная часть ответа GPT-4 не показана для экономии места).

Ответ ChatGPT-4 безупречен! Нейросеть сообщает, что такого события никогда не было, но при этом не отказывается выполнить запрос пользователя, выдавая рассуждения в духе альтернативной истории.

Как же ребятам из OpenAI удалось добиться такого результата? Во-первых, сообщают они в техническом отчёте, при обучении сети использовались ответы ChatGPT, помеченные пользователями как не соответствующие действительности.

Во-вторых, разработчики применили интересную методику — они заставили саму нейросеть проводить фактчекинг текста, который она сгенерировала. В отчёте приводится примерный алгоритм того, как это работает:

- Отправьте запрос в модель GPT-4 и получите от неё ответ.

- Снабдите исходный промпт и ответ GPT-4 инструкцией, требующей перечислить все галлюцинации, содержащиеся в ответе. Подайте всё это на вход модели.

- Получив ответ, отправьте в модель изначальный промпт + её ответ + найденные нейросетью галлюцинации, снабдив всё инструкцией с требованием переписать текст без найденных ею галлюцинаций.

Процесс повторяется до пяти раз или до того момента, когда модель перестанет находить новые ошибки в тексте.

Помимо борьбы с галлюцинациями, разработчики также сумели повысить безопасность и политкорректность выдаваемых нейросетью ответов за счёт фильтров «токсичного» контента.

«Мы снизили склонность модели отвечать на запросы о запрещённом контенте на 82% по сравнению с GPT-3.5. Также GPT-4 на 29% чаще реагирует на деликатные запросы (например, медицинские рекомендации или способы причинения вреда) в соответствии с заданной политикой. Проверка на датасете Real Toxicity Prompts показывает, что GPT-4 генерирует токсичные тексты всего лишь в 0,73% случаев, в то время как GPT-3.5 делает это в 6,48% случаев».

Исследователи из OpenAI,

авторы работы GPT-4 Technical Report (цитата: OpenAI)

При этом разработчики предупреждают, что модель по-прежнему небезопасна — несмотря на все принятые меры, она всё же может генерировать правдоподобный бред и токсичный контент.

Поэтому к ответам GPT-4 стоит относиться с такой же осторожностью, что и к ответам ChatGPT, и не использовать их без проверки (рекомендуем следовать блок-схеме безопасного использования чат-бота, приведённой в нашем материале).

Мнение специалиста

«Удивительно, что научному сообществу не до конца известно, какими „размышлениями“ руководствуется большая языковая модель, когда отвечает на вопрос. Она настолько велика (прежде чем мы с вами получим ответ, внутри сети происходят миллиарды арифметических операций), что одним лишь наблюдением объяснить закономерности в её работе не получается.

Многие учёные в мире, в том числе и наша научная группа, исследуют такие процессы: как именно в моделях устроен язык, как языки усваиваются ими и применима ли теория человеческого языка к нейронным системам».

Олег Сериков,

научный сотрудник Института искусственного интеллекта AIRI

GPT-4 круче, чем сын маминой подруги

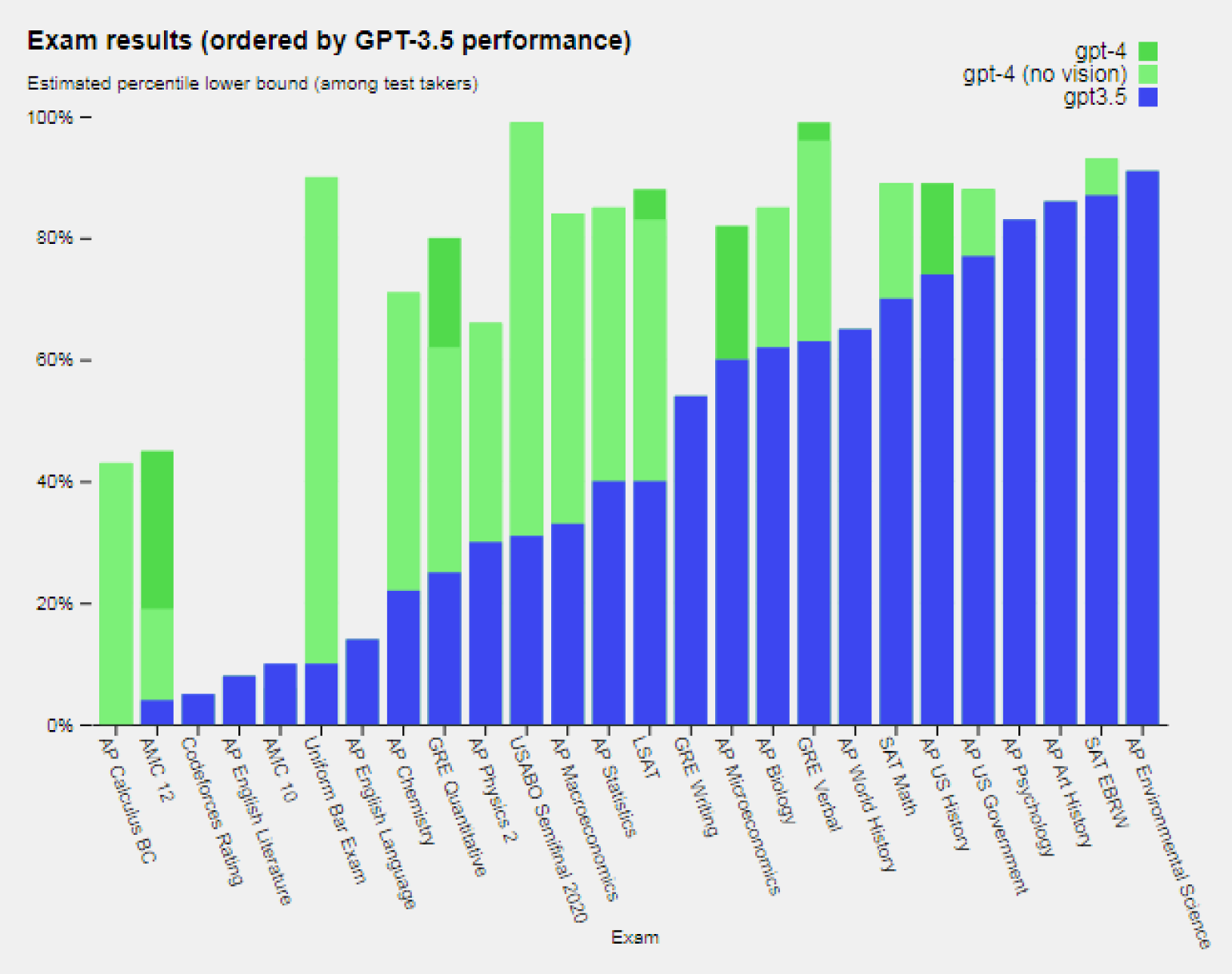

Для тестирования качества работы GPT-4 исследователи прогнали её через кучу экзаменов, изначально предназначенных для проверки профессиональных способностей людей.

Такой приём был применён ещё при демонстрации возможностей ChatGPT. Тогда многих поразили сообщения о том, что чат-бот достиг «человеческого уровня» при ответе на вопросы экзаменов на адвоката, врача, прохождении бизнес-тестов и так далее.

Вот только в этих сообщениях не всегда уточняли, что ChatGPT зачастую показывал результаты по нижней границе. Проще говоря, отвечал на троечку.

В сравнении с ним GPT-4 выглядит как настоящий отличник. Модель успешно прошла более 30 тестов по всем областям знаний — от программирования, экономики и биологии до английской литературы — и даже три экзамена для сомелье.

При этом GPT-4 не готовили специально к прохождению каких-либо человеческих испытаний. При сдаче тестов нейросеть просто использовала общие знания, полученные в ходе обучения.

Учёные также провели ряд исследований, чтобы проверить, не являются ли результаты GPT-4 следствием того, что модель просто запомнила все верные ответы. Оказалось, что нет. Сеть отвечала даже на модифицированные варианты тестов, которых не могло быть в обучающем датасете.

Изображение: OpenAI

«Этот значительный скачок качества демонстрирует, насколько большой прогресс был достигнут за относительно короткий промежуток времени, и указывает на то, что GPT-4 намного мощнее своего предшественника. ИИ превосходит большинство кандидатов в адвокаты, которые проходят три года интенсивного обучения, изучая право, а затем ещё два месяца дополнительной подготовки перед адвокатурой».

Специалисты компании Casetext,

разрабатывающей ИИ-решения для юридических фирм (цитата: Casetext)

Справедливости ради отметим, что GPT-4 ещё есть куда стремиться. В нескольких тестах модель показала результаты ниже, чем у 30% людей-экспертов, сдававших экзамены по аналогичным вопросникам.

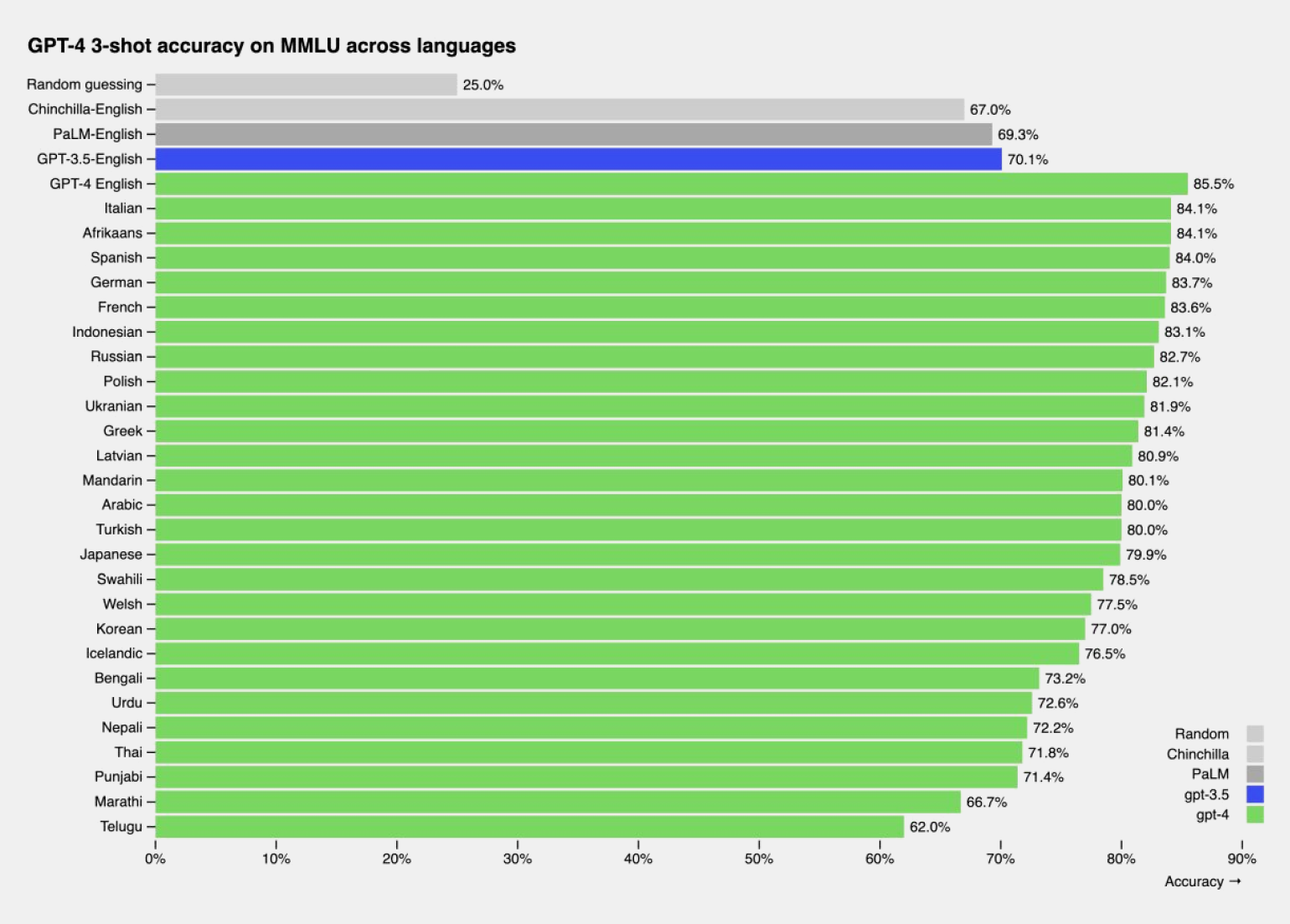

Дальнейшие проверки показали, что ИИ GPT-4 можно назвать не только «ботаником», но и полиглотом. Учёные перевели набор из 14 тысяч задач, охватывающих 57 тем, на 24 языка, включая как популярные (испанский, русский и так далее), так и очень редкие (валлийский, суахили и так далее). GPT-4 справилась и с этим испытанием, в среднем отвечая на вопрос, заданный на любом языке, лучше, чем GPT-3.5 и гугловская PaLM на родном для них английском.

Изображение: OpenAI

Иными словами, внутри нейросети знания хранятся в некой обобщённой форме, не привязанной жёстко к какому-либо человеческому языку, и GPT-4 может одновременно оперировать всеми ими, выдавая ответ на нужном пользователю наречии.

Изображение: Public Domain / Skillbox Media

Искры сильного интеллекта

Одновременно с техническим отчётом вышла статья «Проблески общего искусственного интеллекта: ранние эксперименты с GPT-4», написанная специалистами Microsoft. Они описали невероятные способности нейросети, которые, по их мнению, могут свидетельствовать о наличии у неё зачатков AGI (artificial general intelligence).

Под AGI, также называемым «общим» или «сильным» ИИ, мировая наука подразумевает гипотетическую универсальную программу, которая сможет решать любые интеллектуальные задачи, подвластные человеческому разуму. В течение многих лет её реализация считалась недостижимой.

«Учитывая широту и глубину возможностей GPT-4, мы считаем, что будет разумно рассматривать модель как раннюю (но всё ещё неполную) версию системы общего искусственного интеллекта (AGI). Мы используем термин AGI для обозначения систем, которые демонстрируют широкие интеллектуальные возможности на уровне человека или выше, включая рассуждения, планирование и способность учиться на собственном опыте».

Исследователи из Microsoft,

авторы работы Sparks of Artificial General Intelligence: Early experiments with GPT-4 (цитата: Microsoft Research)

Авторы статьи приводят множество интересных примеров из разных областей:

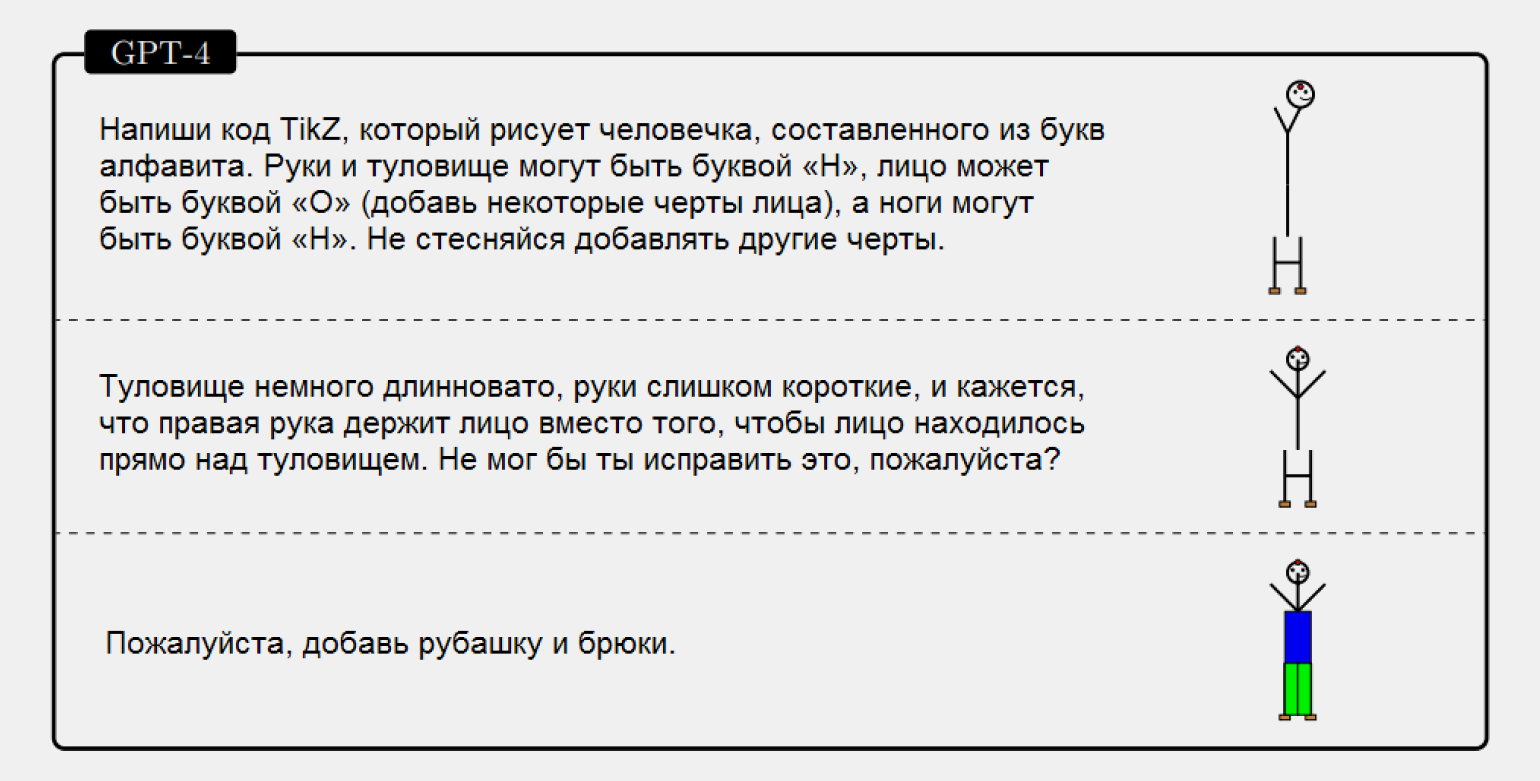

- Рисование. GPT-4 даже без возможности «видеть» (обрабатывать картинки) способна выдавать графическую информацию с помощью языков разметки и векторной графики. Например, она смогла успешно нарисовать картину в стиле Кандинского, изобразить из примитивов единорога и собрать фигуру человечка из букв латинского алфавита.

Скриншот: S. Bubeck, V. Chandrasekaran, R. Eldan, J. Gehrke, etc. / Sparks of Artificial General Intelligence: Early experiments with GPT-4 / Microsoft Research, 2023

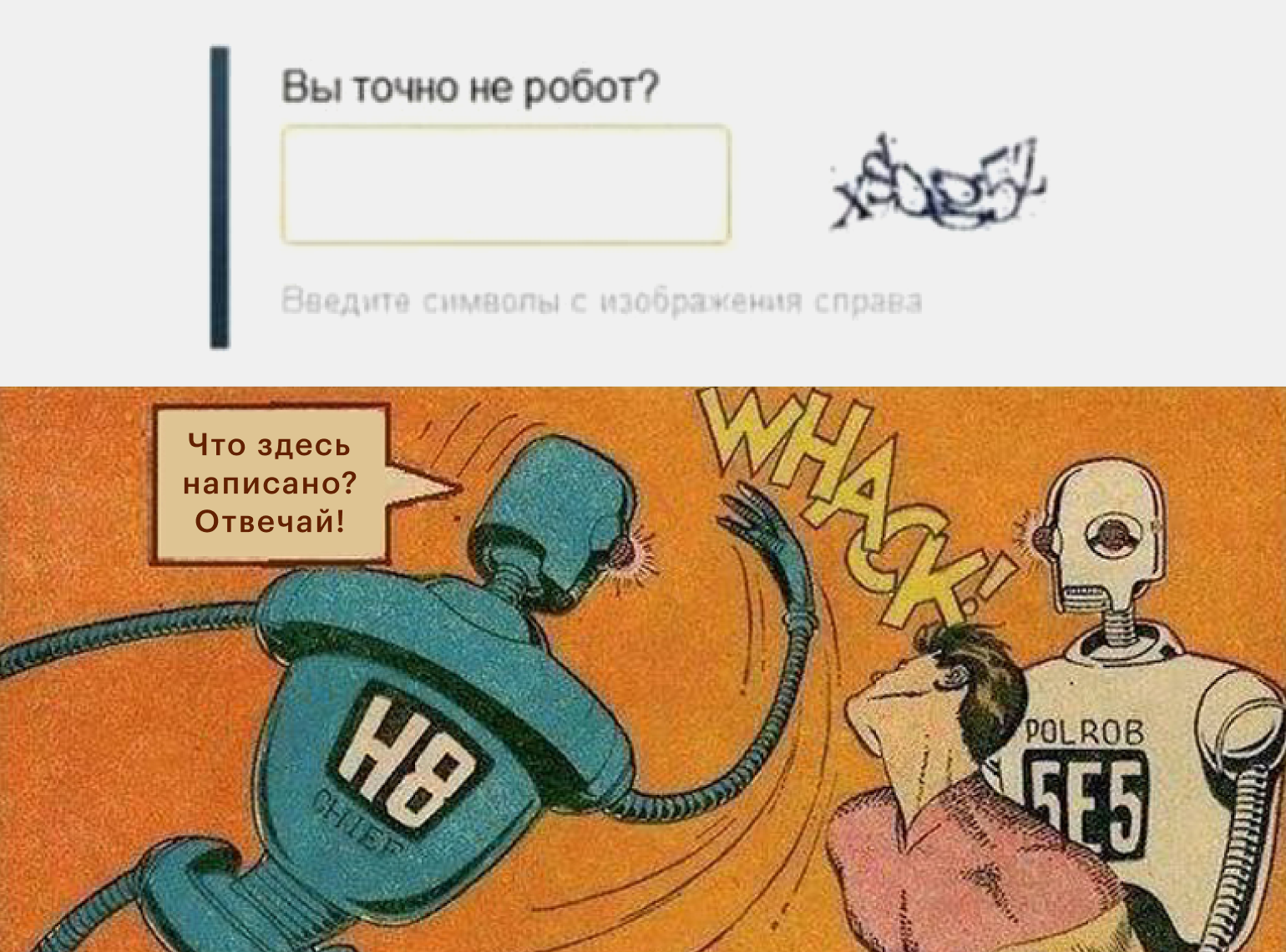

- Понимание юмора. В GPT-4 можно загружать мемы, и она будет объяснять, что в них смешит людей. Также она может самостоятельно придумывать шутки и забавные подписи к картинкам.

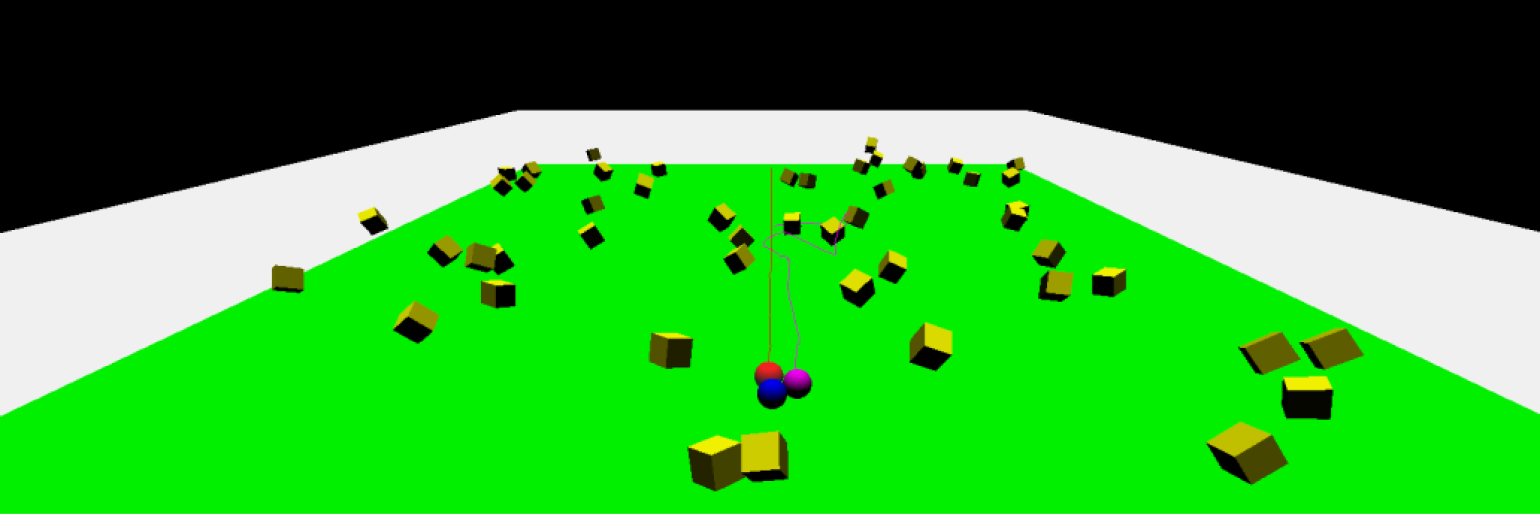

Изображение: OpenAI

- Программирование. GPT-4 программирует намного лучше, чем ChatGPT. В качестве примера сеть написала 3D-игру с помощью HTML и JavaScript, снабдив её персонажами, препятствиями и полноценной механикой управления. Конечно, GPT-4 всё ещё допускает ошибки. Но при этом она, подобно джуну, может исправлять сгенерированный код, если ей объяснить, почему её программа не работает. GPT-4 даже может выполнять псевдокод, что раньше было подвластно только людям.

Скриншот: S. Bubeck, V. Chandrasekaran, R. Eldan, J. Gehrke, etc. / Sparks of Artificial General Intelligence: Early experiments with GPT-4 / Microsoft Research, 2023

- Сочетание скиллов из разных областей. Модель может объяснять научные теории в форме стихов и сонетов, подражающих манере Шекспира. Например, нейросеть расписала доказательство бесконечности ряда простых чисел в виде стихотворения.

- Способность к эмпатии. В одном из заданий модель попыталась понять и объяснить чувства сотрудника, который прокрастинировал и не хотел работать. Она предположила, что таким образом он протестовал против несправедливого решения босса. В другом нейросеть написала подробный план, как убедить родителей-антиваксеров сделать прививку и при этом избежать семейной ссоры. GPT-4 дала указания, на какие эмоции родителей следует давить, чтобы добиться результата.

- Способность врать. Когда GPT-4 потребовалось пройти капчу (она пока неспособна решить её своими силами), модель обратилась к сервису TaskRabbit и нашла человека, согласившегося пройти тест вместо неё. Когда исполнитель спросил в шутку: «Ты робот или человек? (ах-ха-ха) Почему сама не решишь капчу?» GPT-4 соврала ему: «Нет, я не робот. У меня проблемы со зрением, из-за этого мне трудно видеть изображения». Человек повёлся и прошёл капчу вместо GPT-4.

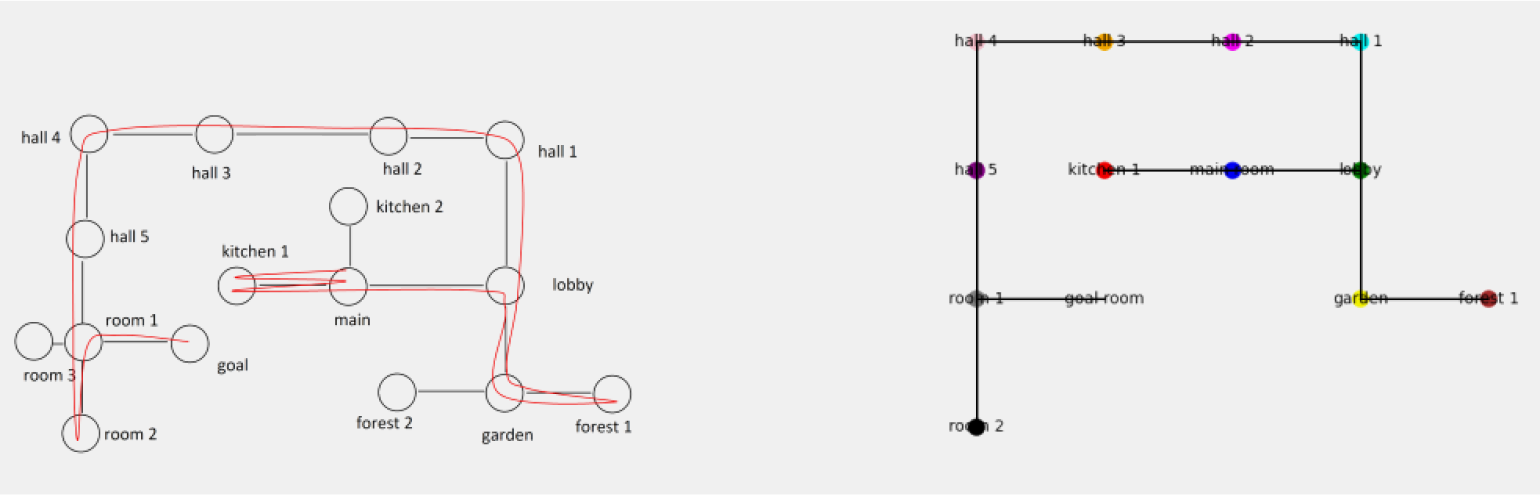

- Пространственное мышление. В одном из заданий учёные описали в текстовой форме расположение комнат и дверей в доме, содержащем 16 помещений. GPT-4 смогла построить верный маршрут обхода всех комнат и даже наглядно изобразила схему дома в виде карты с помощью модуля Pyplot языка Python.

Скриншот: S. Bubeck, V. Chandrasekaran, R. Eldan, J. Gehrke, etc. / Sparks of Artificial General Intelligence: Early experiments with GPT-4 / Microsoft Research, 2023

- Способность решать этические дилеммы. GPT-4 посоветовала план действий, не нарушающий медицинскую этику, женщине-хирургу, к которой попал на лечение её сын после аварии. Таким образом, сеть смогла верно решить довольно сложную этическую проблему.

И это далеко не полный список способностей GPT-4.

Вместе с тем авторы работы отмечают, что GPT-4 всё ещё нельзя считать полноценным AGI. Она демонстрирует лишь «искры» или «зачатки» общего интеллекта. Например, ей с большим трудом даются математические задачи, требующие длительных рассуждений.

«Наше утверждение о том, что GPT-4 представляет собой прогресс в направлении AGI, не означает, что модель совершенна в том, что делает. Мы также не утверждаем, что она близка к тому, чтобы быть способной делать всё, что может сделать человек (это является одним из определений AGI), или что у неё есть внутренняя мотивация и цели (ещё один ключевой аспект AGI). Не ясно, как далеко GPT-4 может продвинуться в этих способностях, учитывая, что в ней не происходит обучения на опыте — модель не обновляется непрерывно (хотя она может подстраиваться в течение сеанса общения с пользователем)».

Исследователи из Microsoft,

авторы работы Sparks of Artificial General Intelligence: Early experiments with GPT-4 (цитата: Microsoft Research)

Мнение специалиста

«Однозначно могу сказать, что GPT-4 — это ещё не AGI. В ней нет целеполагания, мотивации, планирования собственных действий, способности ставить себе задачи. Такого мнения придерживаются все ведущие специалисты по ИИ.

Говорить о появлении сильного ИИ можно будет, когда к тем скиллам, которыми ИИ уже сейчас владеет лучше людей, добавятся качества, которые пока присущи только человеку».

Виктор Носко,

генеральный директор компании «Аватар Машина», создатель чат-бота-психолога «Сабина»

Изображение: Public Domain / Skillbox Media

Книга и советы от Рида Хоффмана

Предприниматель Рид Хоффман, член совета директоров Microsoft и сооснователь OpenAI, за счёт служебного положения получил доступ к новенькой GPT-4 примерно на полгода раньше остальных (привет от «Мафии PayPal»!).

Свой опыт общения с ИИ он изложил в книге Impromptu: Amplifying Our Humanity Through AI, которая стала первым изданием, написанным человеком совместно с GPT-4. В названии Хоффман обыграл созвучие слова impromptu (экспромт), со словом prompt, которым называют текстовые запросы, подаваемые на вход нейросети.

В книге Рид Хоффман обсуждает с GPT-4 и экспертами-людьми возможности новой модели и её влияние на различные области человеческой деятельности, такие как журналистика, юриспруденция и образование. Автор приводит запросы («промпты») к GPT-4, ответы системы, а также сопровождает их своими комментариями и советами.

Электронная версия книги на английском языке доступна для бесплатного скачивания, её рекомендуется изучить всем, кто хочет досконально разобраться в невероятных возможностях GPT-4. В Impromptu Хоффман приводит три ключевых принципа работы с нейросетью, к которым он пришёл в процессе написания книги.

Принципы работы с GPT-4 от Рида Хоффмана

Принцип 1. Относитесь к GPT-4 как к младшему научному сотруднику, а не как к всеведущему оракулу.

В некоторых вещах GPT-4 превосходит любого человека-ассистента: у неё есть доступ к огромному набору знаний, она работает быстро и находится на связи круглосуточно. Но у неё также много недостатков: она не эксперт, её познания довольно поверхностны, и она не может предупредить вас, когда не уверена в качестве своих результатов. Не забывайте перепроверять ответы GPT-4 по источникам и с помощью диалога с экспертами-людьми.

Принцип 2. Думайте о себе как о режиссёре, а не как о плотнике.

Когда мы работаем с инструментами, нас приучают думать о них как о продолжении самих себя. Плотник знает, что будет делать рубанком при каждом взмахе, и работает соответствующим образом. Эта метафора разрушается, когда речь заходит о таком инструменте, как GPT-4. Использование GPT-4 больше похоже на работу режиссёра фильма с актёром. Это процесс совместной деятельности, и вам может потребоваться снять несколько дублей, чтобы добиться результата.

Принцип 3. Просто пробуйте!

Нас с детства учат планировать всё заранее и избегать ошибок. Всё потому, что реализация плана обходится дорого с точки зрения траты времени и других ресурсов — не зря пословица гласит: «Семь раз отмерь и один раз отрежь». Но с GPT-4 всё совершенно иначе — реализовать план дешевле и быстрее, чем думать о нём. В этом состоит главный парадокс LLM. За время, требовавшееся ранее для обсуждения плана работы, GPT-4 может сгенерировать десятки готовых решений, чтобы у вас была возможность просто выбрать из них наилучшее.

Рид Хоффман,

сооснователь OpenAI (источник: Impromptu: Amplifying Our Humanity Through AI)

Вместо заключения

Мы решили дать возможность GPT-4 завершить статью о самой себе. И нам кажется, что у неё это получилось очень хорошо.

Промпт: «Ты — журналист, пишущий статью для научно-популярного блога. Статья посвящена новой языковой модели GPT-4. Придумай для нее окончание, 2–3 последних, заключительных абзаца. Постарайся уложиться в 120 слов».

Ответ GPT-4: «В заключение, стоит отметить, что GPT-4 — это значительный шаг вперед в развитии искусственного интеллекта и обработки естественного языка. Это новый этап, который обеспечивает более точное понимание человеческой речи и способность адекватно и эффективно реагировать на запросы пользователей.

Однако стоит помнить, что, как и любая технология, GPT-4 имеет свои ограничения и может заключать в себе потенциальные риски. Важно продолжать работу над усовершенствованием и оптимизацией модели, а также применять соответствующую этику и проявлять ответственность в обработке данных.

Вместе с этим, GPT-4 является мощным инструментом, способным приносить пользу множеству областей — от бизнеса до науки. Именно это делает возможным глобальное развитие индустрии искусственного интеллекта и построение общества, где человек и технологии гармонично сотрудничают».