Убить и не дать кредит. Что искусственный интеллект может сделать с вами уже сегодня

Как «понравиться» алгоритмам HeadHunter? Зачем банки используют нейросети? Какие правила Азимова искусственный интеллект уже нарушил?

Антиутопия в режиме реального времени

Сначала плохие новости. Уже несколько лет искусственный интеллект оценивает людей. В зависимости от выводов, которые делает алгоритм, вы можете получить работу, кредит (или отказ в них) или штраф.

Бывают и более серьёзные случаи. Например, в ряде штатов США искусственный интеллект используют в судебной системе. Система COMPAS оценивает вероятность рецидива. Она изучает биографию подсудимого, анализирует результаты психологических тестов и пытается предсказать, насколько вероятно, что он совершит преступление ещё раз. Результаты проведённого машиной исследования рассматривают в суде наряду с другими свидетельствами и доказательствами. То есть от алгоритма во многом зависит приговор.

А в марте 2020 года искусственный интеллект впервые в истории атаковал людей. Американский журнал Bulletin of the Atomic Scientists, ссылаясь на доклад экспертов ООН, пишет, что турецкий беспилотник Kargu-2, который находился в автономном режиме, самостоятельно принял решение напасть на солдат Ливийской национальной армии. В публикации говорится, что дроны этой модели начинают атаку, основываясь на данных, которые им «показывали» в ходе машинного обучения.

Фото: Wikimedia Commons

Всё это и так выглядит пугающе, а пандемия дополнительно ускорила развитие технологий. Изменения, которые бизнес и государство откладывали годами, в 2020–2021 годах происходят каждый день. Чем это может обернуться в будущем и чем мы рискуем прямо сейчас? Skillbox Media разбирается, как используют искусственный интеллект в крупнейших российских банках, из-за чего алгоритм может отказать кандидату в работе и есть ли смысл оспаривать штраф за то, что тень вашего автомобиля «наехала» на разметку.

Зачем нужны штрафы для пешеходов и группы для водителей

В контроле за дорогой с помощью искусственного интеллекта сегодня лидирует Китай. Там уже выписывают штрафы на нарушения ПДД не только автомобилистам, но и пешеходам, используя для этого систему распознавания лиц. В России пока ничего подобного нет.

Первые камеры появились на российских дорогах в 2008 году. А уже в 2012-м для распознавания зафиксированных ими нарушений стали активно использовать нейросети. «Сегодня в России 17 тысяч стационарных камер и 5 тысяч мобильных. С каждым годом технологии дешевеют, поэтому скоро их, наверное, будет не 17, а 170 тысяч. К тому же расширяется их функциональность.

Современные камеры распознают 22 типа нарушений ПДД во всех полосах. Например, с 2020 года камеры научились распознавать водителей, которые разговаривают по телефону. То есть, искусственный интеллект уже умеет анализировать происходящее в салоне. Он „понимает“, что человек говорит по телефону, а не просто чешет ухо», — рассказал Skillbox Media координатор движения «Синие ведёрки» Пётр Шкуматов.

Строго говоря, камера фиксирует не нарушение, а событие с признаками нарушения, поясняет эксперт по системам фотовидеофиксации Григорий Шухман: «Назначение камер — выявить событие с признаками административного правонарушения и задокументировать его. Решение о штрафе всегда выносит человек, сотрудник ведомства (например, в Москве это ГИБДД, МАДИ и АМПП). Но на практике многие думают, что, раз камера зафиксировала событие, значит, это нарушение. А если водитель считает иначе, то пусть докажет это».

Именно из-за такого отношения происходят ошибки и автомобилистам выписывают незаслуженные штрафы. Проблема в том, что оспорить их очень тяжело. Пётр Шкуматов («Синие ведёрки») объяснил это отсталостью системы обжалования: «В эту систему никакие нейросети пока не пришли. Там всё аналоговое и работает на технологиях середины прошлого века. Чаще всего овчинка не стоит выделки: поездки по судам и переписка через «Почту России» обойдутся в десять раз дороже самого штрафа.

Самый курьёзный случай на моей памяти — это штраф за тень. Представьте: едет автомобиль, солнце освещает его сбоку. Машина отбрасывает тень. В какой-то момент эта тень пересекает сплошную линию разметки. Камера «считает», что тень — часть автомобиля. Водителю приходит штраф. Это реальный случай, который произошёл в 2018 году.

К счастью, сегодня алгоритмы усовершенствовали настолько, что подобных ошибок они уже не делают. Но проблемы остались. Часто камера фиксирует пограничные ситуации: автомобиль задел одним колесом разметку или заехал на 1 мм на стоп-линию. С точки зрения здравого смысла ничего не произошло, но для алгоритма это всё равно нарушения. И за такие вещи водителей штрафуют».

Чтобы избежать подобного абсурда, Пётр предлагает применять риск-ориентированный подход. Система камер уже накопила большой массив данных о том, как ездит тот или иной водитель: «Опираясь на эти данные, можно разделить всех автомобилистов на группы риска, как это делают страховщики. Например, на зелёную, жёлтую и красную.

Красная группа — это потенциально опасные водители. При этом подход к каждой группе должен быть разным: если камера фиксирует нарушение у водителя из зелёной группы, у него снижается рейтинг. А если нарушает водитель из красной группы, то его штрафуют».

Неудачное фото, плохая компания и другие причины для отказа в кредите

Ещё одна сфера, где искусственный интеллект оценивает людей, — это кредитование. Нейросети уже научились определять кредитоспособность человека по тому, на что и как он тратит деньги. Более того, они могут изучить социальные связи заёмщика, исходя из того, каким людям он отправляет переводы. Создатели алгоритма, который работает по такому принципу, признаются, что вдохновлялись принципом «Скажи мне, кто твой друг, и я скажу, кто ты».

Российская компания FscoreLab пошла ещё дальше и научила нейросеть вычислять потенциально проблемных заёмщиков по фото в паспорте. Как сообщает разработчик, изучив 600 тысяч фотографий из Бюро кредитных историй, алгоритм выявил черты, свойственные лицам должников.

К сожалению, не все финансовые организации раскрывают принципы кредитного скоринга, которые они используют. Но алгоритмы точно проверяют потенциальных заёмщиков в крупнейших российских банках:

«В кредитном процессе уже давно используются модели машинного обучения — например, для определения ожидаемого уровня доходов клиентов. Наш банк начал активно развивать использование искусственного интеллекта в рамках технологической трансформации», — рассказал Skillbox Media руководитель департамента анализа данных и моделирования ВТБ Максим Коновалихин.

В МКБ искусственный интеллект и машинное обучение используют для обработки кредитных заявок уже 10 лет. Но банк не раскрывает данные, на основе которых алгоритм делает выводы:

«Детали реализации алгоритма и перечень используемых данных — закрытая информация. Можем назвать лишь общие, очевидные категории данных. Это документы и сведения, подтверждающие платёжеспособность, которые предоставляет сам клиент (в том числе через цифровые сервисы), внутренняя история взаимоотношений клиента и банка, внешние данные из Бюро кредитных историй, а также весь набор накопленных банком исторических данных по клиентской базе, позволяющий построить модель оценки риска конкретного заёмщика на основе прямых и косвенных признаков и поведенческих паттернов», — объяснил руководитель направления инновационных решений ИТ-дирекции МКБ Александр Феденко.

Чьи резюме забракует нейросеть

В сфере найма искусственный интеллект чаще всего используют для первичной оценки кандидатов. Например, McDonald’s, JP Morgan, PWC и Kraft Heinz тестируют соискателей с помощью системы Pymetrics. Она автоматически оценивает когнитивные способности человека и его эмоциональные реакции.

Такие технологии экономят время HR-менеджеров, особенно при поиске кандидатов на массовые вакансии, а со временем могут и вовсе заменить людей, работающих в найме. По прогнозам онлайн-издания Undercover Recruiter, через 10 лет искусственный интеллект заменит 16% сотрудников HR-отделов.

У многих это вызывает опасения. Нейросети ошибаются, а значит, их распространение может привести к дискриминации. Городской совет Нью-Йорка уже обсуждает правила, которые должны ограничить применение искусственного интеллекта в HR.

Сами по себе нейросети не решают, кого брать на работу, а кому отказать. Это по-прежнему делают люди. Но в крупных компаниях и на популярных площадках для поиска работы, прежде чем человек откроет резюме, его успевает просмотреть алгоритм. Так, например, работает сервис hh.ru:

«После того как соискатель создал резюме, оно отправляется на модерацию. 74% всех резюме модерируются без участия человека. Искусственный интеллект может не пропустить резюме на публикацию по разным причинам. К примеру, если там есть мат, если зарплатные ожидания очень сильно завышены, если формулировки недостаточно конкретные (например, „что-нибудь в рекламе“) или если информации недостаточно. Например, человек пишет: „Я был директором 20 лет“ — и не уточняет, где именно. Авторы таких резюме получают сообщения о том, что текст не прошёл модерацию. Чтобы решить проблему, им предлагают связаться с техподдержкой», — рассказал Skillbox Media руководитель направления анализа данных HeadHunter Александр Сидоров.

Работодателям алгоритмы hh.ru помогают найти наиболее подходящих на вакансию кандидатов. Их резюме сервис показывает в первую очередь. Это похоже на систему рекомендаций видео- и музыкальных сервисов.

Искусственный интеллект не только сопоставляет текст резюме с текстом вакансии, но и изучает поведение работодателя на сервисе:

«Система анализирует, каких кандидатов компания чаще приглашает на собеседование и предлагает ей резюме похожих специалистов. Кроме этого, учитывается географический фактор: кладовщик или кассир не поедет на другой конец города, если может найти работу рядом с домом», — говорит Александр Сидоров. Он также объяснил Skillbox Media, что на работу нейросетей почти не влияют преувеличения заслуг в резюме, потому что «люди преувеличивают примерно одинаково».

HeadHunter применяет искусственный интеллект только в работе с текстом и геокоординатами резюме и вакансий, изучает с помощью алгоритмов поведение работодателей и кандидатов. Искусственный интеллект пока не анализирует фото и активность соискателей в соцсетях, хотя представители площадки признают, что большинство компаний смотрят на посты и профили кандидатов.

Фантастика для законодателей и две разные роли для ИИ

Бум нейросетей, который произошёл в начале 2010-х и быстрое развитие искусственного интеллекта, последовавшее за ним, вызывают разные эмоции — от умиления и надежды до ужаса. Сегодня алгоритмы помогают врачам ставить диагнозы, умеют придумывать анекдоты и рисовать аниме. Но их «родственники» управляют военными дронами и беспилотными автомобилями, а также оценивают вашу кредитоспособность по фотографии.

Всё это заставляет задуматься о законодательных ограничениях для искусственного интеллекта, по крайней мере в самых «чувствительных» сферах. В ряде стран такие меры уже обсуждают. Так, в ЕС собираются запретить использовать распознавание лиц в общественных местах. Под эгидой ООН уже несколько лет ведутся переговоры об ограничении искусственного интеллекта в военной сфере.

В России тоже есть подобные инициативы. В апреле 2021 года юристы из Комиссии по правовому обеспечению цифровой экономики направили письма со своими идеями о том, как лучше регламентировать рынок ИИ, в Совет Федерации, Госдуму, Минцифры и Роскомнадзор. Председатель Комиссии Александр Журавлёв заявил Skillbox Media:

«Я считаю, что единственного верного решения нет. Следует рассматривать разные варианты в зависимости от того, в какой сфере применяется технология, и её автономности в принятии решения. В целом, мне кажется, искусственный интеллект пока должен оставаться помощником человека, то есть не должен принимать самостоятельных решений. Уточню, что речь идёт только тех о решениях, которые могли бы повлиять на человека, то есть иметь юридически значимые последствия.

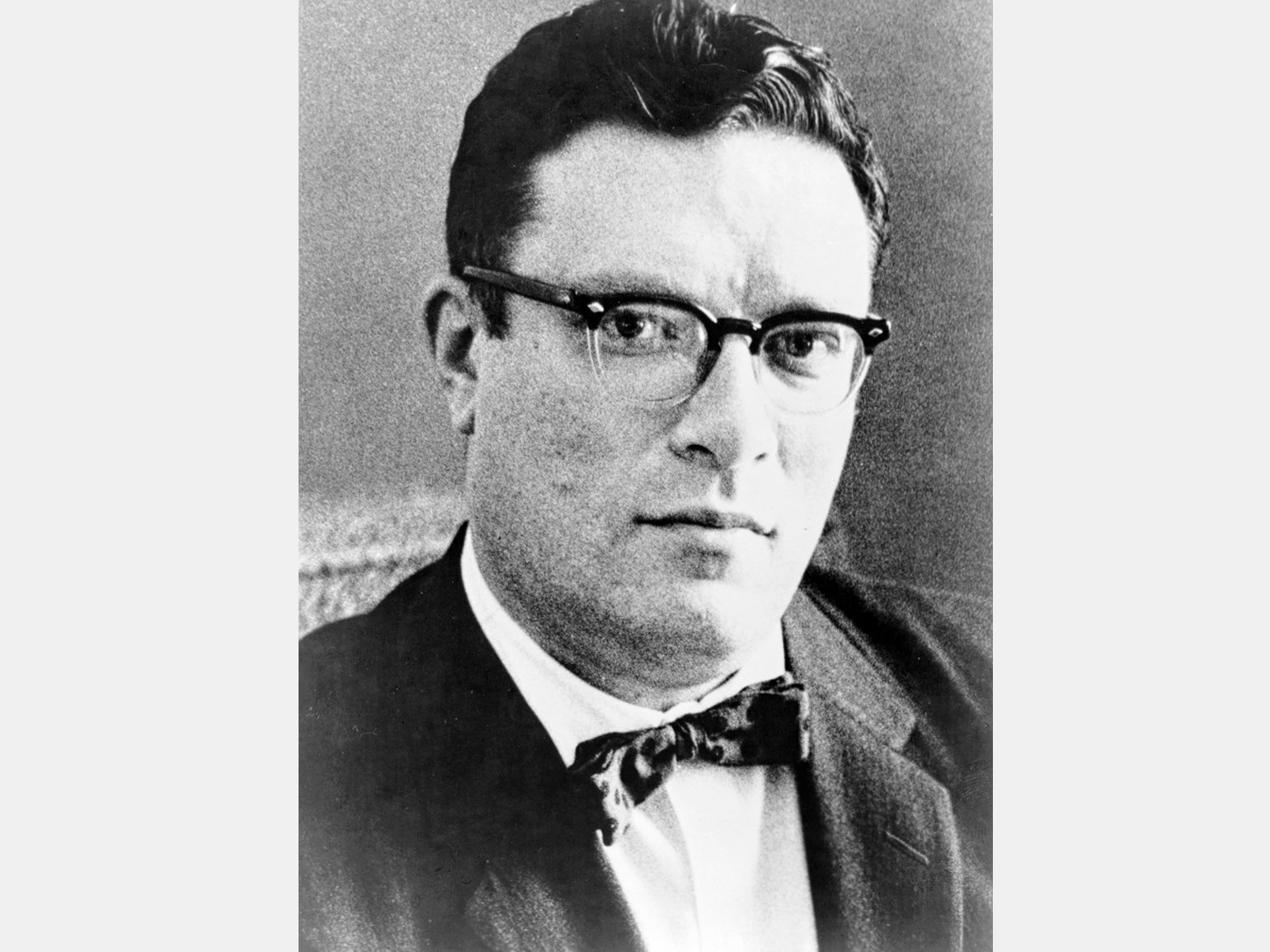

В любом ПО могут обнаружиться изначально неверные алгоритмы, ошибки в исходных данных, могут произойти сбои. Чтобы они не калечили судьбы и не приводили к смертям людей, следует обратиться к «трём законам робототехники», сформулированным Айзеком Азимовым:

- Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинён вред.

- Робот должен повиноваться всем приказам, которые даёт человек, кроме тех случаев, когда эти приказы противоречат Первому Закону.

- Робот должен заботиться о своей безопасности в той мере, в которой это не противоречит Первому или Второму Законам.

С учётом развития ИИ эти законы можно интерпретировать так:

- Запрет на причинение вреда человеку по инициативе систем ИИ и робототехники.

- Подконтрольность ИИ человеку (в той мере, в которой это возможно).

- Запрет на манипулирование поведением человека с помощью технологий».

Но не все согласны с тем, чтобы ограничить искусственный интеллект скромной ролью помощника. Нобелевский лауреат Даниэль Канеман считает, что он уже превосходит человеческий разум во многих областях. Например, быстрее адаптируется к изменениям и лучше разбирается в бизнесе, а со временем «победит» человека. Правда, это произойдёт не сегодня и не завтра, а «при наших внуках и правнуках».