Тест Тьюринга: отличите ли вы ИИ от человека

Тест Тьюринга придумали задолго до ChatGPT. До сих пор никто его не прошёл, но хайпа вокруг него не меньше, чем по поводу новомодных игрушек.

В 1950 году знаменитый британский математик Алан Тьюринг опубликовал статью «Вычислительные машины и разум», в которой задался вопросом: могут ли компьютеры имитировать человеческий мозг?

Не правда ли, это чем-то похоже на сегодняшние новости в духе «Скоро ChatGPT заменит программистов-джунов» или «Через пару лет все статьи будут писать роботы»?

Чтобы ответить на этот вопрос, Тьюринг предложил тест, цель которого — определить, могут ли компьютеры мыслить. Споры о нём не утихают до сих пор. Добавим и мы свои пять копеек в эту дискуссию.

Философские корни теста Тьюринга

Вопрос о том, могут ли машины мыслить, возник довольно давно. Например, знаменитый французский философ и математик Рене Декарт считал, что механизм может взаимодействовать с человеком, но не способен реагировать на всё, что говорится в его присутствии.

«Сколько различных автоматов или движущихся машин может быть создано человеческим трудом… Ибо мы легко можем понять, что машина устроена так, что она может произносить слова и даже давать некоторые ответы, когда мы воздействуем на неё… Но никогда не бывает так, что она выстраивает свою речь различными способами, чтобы ответить соответствующим образом на всё, что может быть сказано в её присутствии, как это может сделать даже самый низкий вид человека».

Рене Декарт,

«Рассуждение о методе, чтобы хорошо направлять свой разум и отыскивать истину в науках»

Таким образом, Декарт фактически предвосхитил тест Тьюринга, заявив, что одной языковой реакции недостаточно, чтобы отличить живого человека от созданной им имитации разума. Другой философ, Дени Дидро в 1746 году также сформулировал критерий теста Тьюринга; правда, он говорил о живых существах.

«Если бы нашёлся попугай, отвечающий на все вопросы, я заявил бы не колеблясь, что он мыслящее существо…»

Дени Дидро,

«Философские мысли»

В 1936 году Альфред Айер ещё ближе подобрался к тесту Тьюринга, задавшись вопросом: откуда мы знаем, что другие люди имеют тот же сознательный опыт, что и мы? Для ответа на этот вопрос, он предложил тест.

«Единственное основание, которое я могу иметь для утверждения, что объект, который кажется сознательным, на самом деле не является сознательным существом, а только манекеном или машиной — это то, что он не удовлетворяет одному из эмпирических тестов, с помощью которых определяется наличие или отсутствие сознания».

Альфред Айер,

«Язык, правда и логика»

Тесты, которые определяли, является ли компьютер разумным, появились также в научной фантастике 1940-х годов, и вполне возможно, что Тьюринг знал о них.

Суть теста Тьюринга: игра в имитацию

Алан Тьюринг интересовался проблемой искусственного интеллекта с начала 1940-х. Свои соображения он изложил в отдельной статье, которая начиналась буквально с места в карьер: «Могут ли машины мыслить?»

Поскольку каждый понимает семантику слов «машина» и «мыслить» по-своему, с самого начала могла возникнуть путаница. Чтобы её избежать, автор решил описать суть проблемы в терминах популярного в те годы развлечения — «игры в имитацию».

Она заключалась в том, что в разных комнатах сидели мужчина и женщина, а гости писали им вопросы и получали ответы, напечатанные на машинке. По этим ответам гости пытались определить, где мужчина, а где женщина. Те, в свою очередь, старались запутать гостей. Тьюринг предложил заменить одного из игроков на какой-нибудь из существовавших тогда прототипов ЭВМ.

«Зададимся вопросом: что произойдёт, если машина возьмёт на себя роль А в этой игре? Будет ли спрашивающий ошибаться так же часто, как в случае, когда игра ведётся между мужчиной и женщиной? Эти вопросы заменят наш первоначальный: могут ли машины думать?»

Алан Тьюринг,

«Вычислительные машины и разум»

Такова первая версия теста. По сути, Тьюринг спрашивает, способен ли искусственный интеллект демонстрировать поведение, неотличимое от человеческого.

«Алан Тьюринг в своей знаменитой статье указал, что вместо поиска ответа на вопрос, могут ли машины мыслить, мы должны интересоваться тем, способны ли машины пройти поведенческий тест интеллектуальности».

Питер Норвиг, Стюарт Рассел,

из книги «Искусственный интеллект: современный подход»

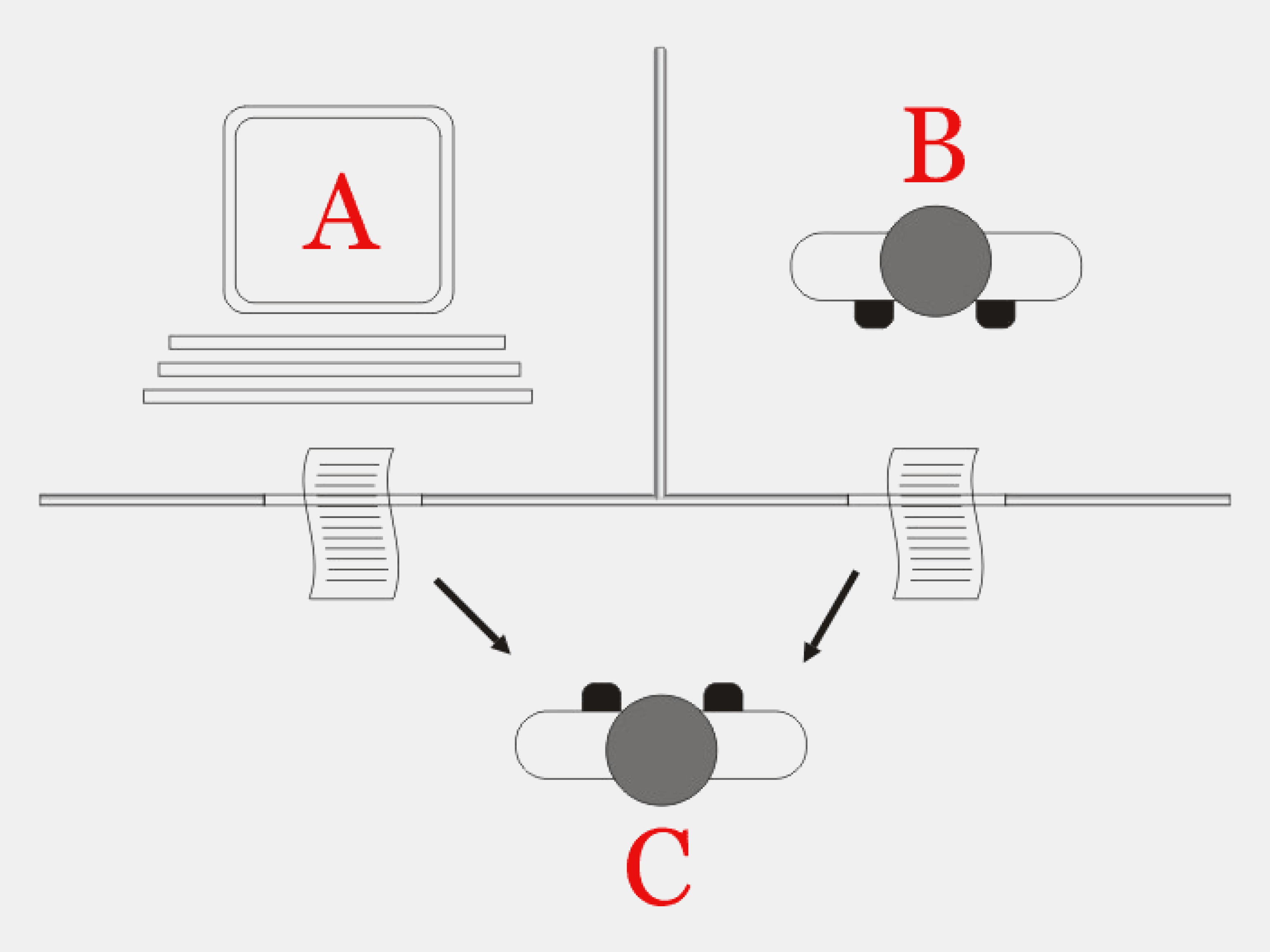

Вторая версия теста предполагает участие двух людей и ЭВМ. Каждый находится в отдельном помещении и не может видеть других. Один человек общается с машиной с помощью письменных сообщений, а другой пытается понять, who is who. Если ему не удастся определить, кто из двух собеседников машина, считается, что она прошла тест.

Изображение: Wikimedia Commons

Позже в эфире радио «Би-би-си» Тьюринг озвучил третью версию теста, где жюри задаёт вопросы компьютеру, а тот старается убедить их в том, что он человек. Тест считался бы пройденным, если бы ЭВМ удалось обмануть человека в 30% случаев. Тьюринг был первым, кто обратил внимание на важность поведения при оценке интеллекта.

«Тест был задуман как мысленный эксперимент, чтобы объяснить людям, которые в то время были настроены очень скептически, что возможность существования разумных машин не зависит от достижений сознания — у вас может быть машина, которая ведёт себя разумно, потому что её поведение неотличимо от человеческого».

Стюарт Рассел,

исследователь ИИ из штата Калифорния (США), в интервью журналу Business Insider

Плюсы и минусы теста Тьюринга

Самый большой плюс теста — в его простоте и универсальности. Тьюринг предложил единственный более-менее измеряемый критерий оценки машины — способность имитировать человеческое поведение. При этом тест не определяет уровень её интеллекта, «сознательность» и прочие довольно оценочные параметры.

Тест строится на разговоре, пусть и в виде переписки. Значит, машина должна разбираться в разных темах, уметь рассуждать, что предполагает высокий уровень развития. Кроме того, с помощью видео можно показывать машине предметы и тестировать её навыки в сфере компьютерного зрения.

«Метод вопросов и ответов, похоже, подходит для обсуждения практически любой из областей человеческой деятельности».

Алан Тьюринг,

«Вычислительные машины и разум»

Недостатки теста являются во многом продолжением его достоинств. В частности, он не учитывает, что люди нередко ведут себя более чем неразумно. Соответственно, если машина покажет себя намного умнее человека, блеснёт более глубокими познаниями, аналитическими способностями или скоростью вычислений, она может провалить тест.

Известные специалисты по искусственному интеллекту Стюарт Рассел и Питер Норвиг считают, что гораздо важнее исследовать основополагающие принципы интеллекта, чем имитировать его естественных носителей.

«Проблему искусственного полёта удалось успешно решить лишь после того, как братья Райт и другие исследователи перестали имитировать птиц и приступили к изучению аэродинамики. В научных и технических работах по воздухоплаванию цель этой области знаний не определяется как создание машин, которые в своём полёте настолько напоминают голубей, что даже могут обмануть настоящих птиц».

Стюарт Рассел, Питер Норвиг,

«Искусственный интеллект: современный подход»

Кто прошёл тест Тьюринга: на какие вопросы отвечали и как с ними справились

В современном мире компьютеры делают многое из того, на что раньше были способны только люди. Они обыгрывают чемпионов в шашки и шахматы, проверяют грамматику и орфографию, водят автомобили, пилотируют самолёты и делают много что ещё. Но при этом ни одна программа или машина до сих пор не смогла преодолеть барьер в 30% и ввести в заблуждение специально обученных судей — по крайней мере, ни один из результатов пока ещё не признан всеми бесспорно.

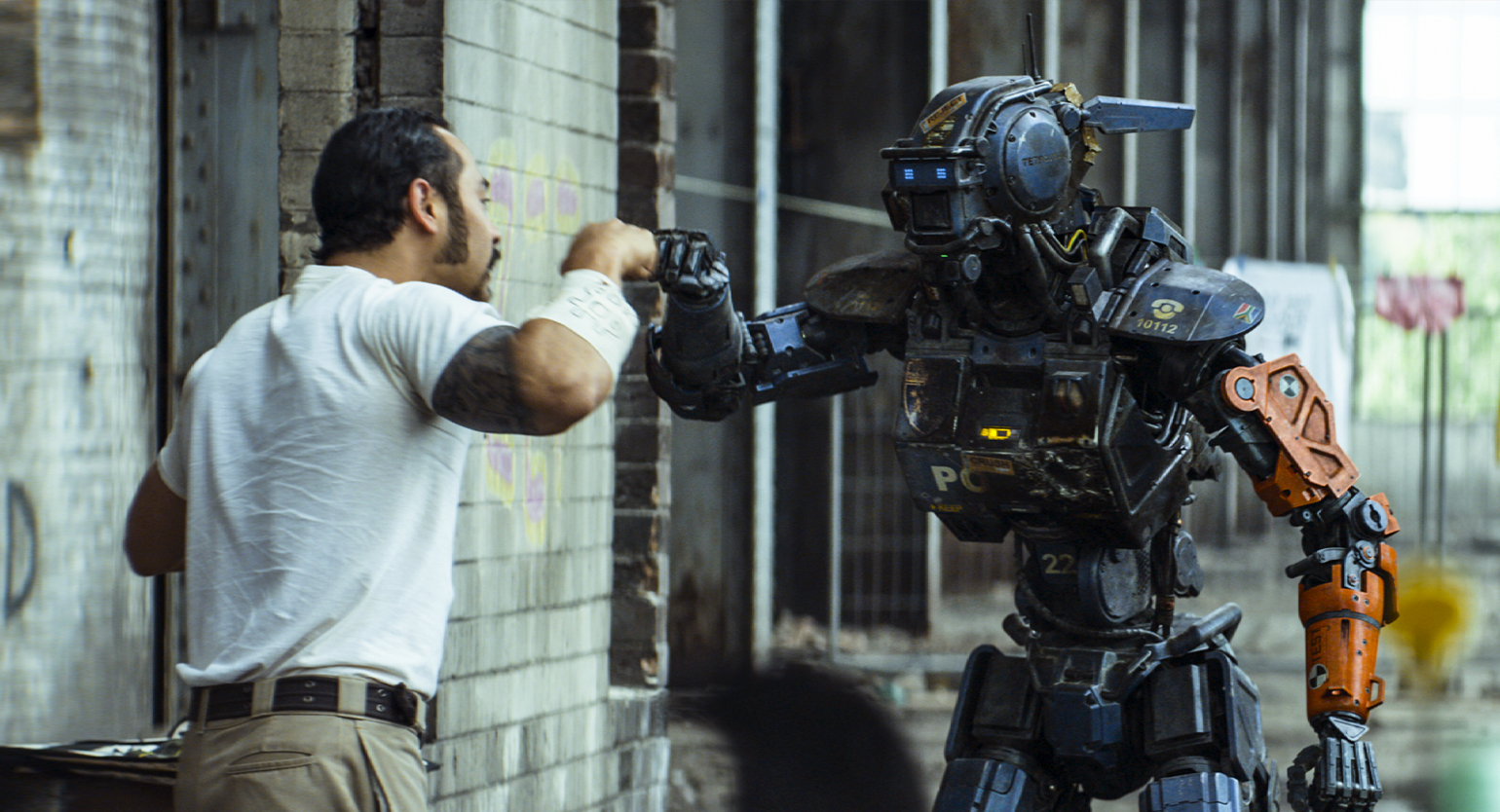

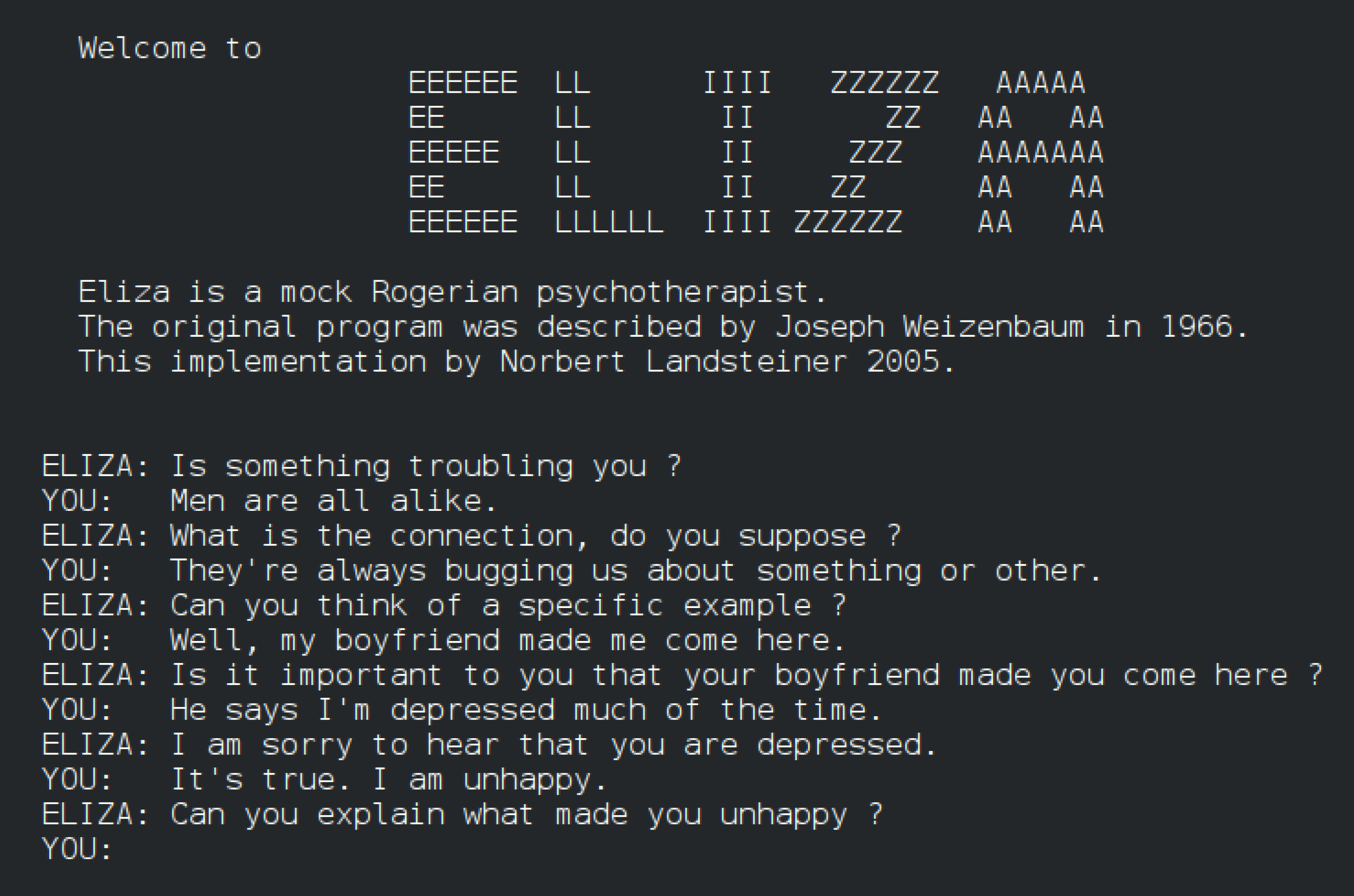

Хотя претенденты, конечно же, были. Одной из первых программ, которая якобы прошла тест Тьюринга, стала Eliza, написанная американским учёным Джозефом Вейценбаумом в 1966 году. Она имитировала диалог с психотерапевтом, в основном перефразируя реплики человека:

— У меня болит голова.

— Почему вы говорите, что у вас болит голова?

Изображение: Wikimedia Commons

А если Eliza не могла придумать ответ, то говорила: «Понятно». Тем не менее некоторые люди и правда поверили, что общаются с человеком. На этом основании программу назвали первой, прошедшей тест Тьюринга. Но это крайне спорное утверждение, потому что людям заранее говорили, что они будут разговаривать с психотерапевтом.

В 1972 году психиатр Кеннет Колби из Стэнфордского университета написал программу Parry. Это была попытка имитировать человека с параноидальной шизофренией. Сначала опытные психиатры общались с реальными пациентами и Parry по телетайпу. Затем другой группе из 33 психиатров показали распечатки бесед. После этого их попросили определить, кто из «пациентов» был человеком, а кто — компьютерной программой. Психиатры дали верный ответ только в 48% случаев, что соответствует случайному угадыванию.

В 1988 году британский исследователь ИИ Ролло Карпентер написал веб-приложение Cleverbot. В 2011 году оно приняло участие в тесте Тьюринга, и в 59,3% случаев его признали человеком.

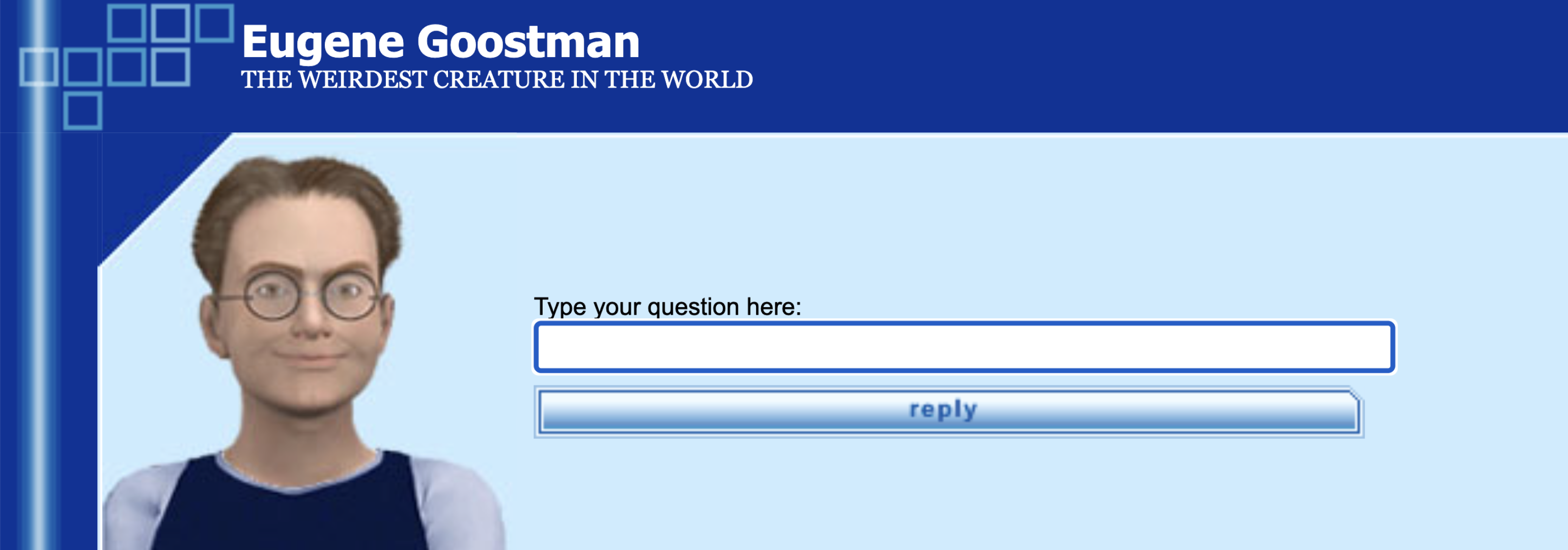

Скриншот: Eugene Goostman / Skillbox Media

В 2014 году мировые СМИ облетела новость — чат-бот впервые прошёл тест Тьюринга. Им оказался «Женя Густман» (Eugene Goostman) — чат-бот, созданный тремя программистами в Санкт-Петербурге. Для того чтобы придать боту убедительности, они сделали его 13-летним мальчиком из Одессы. Образ подростка, плохо говорящего по-английски, позволял объяснить незнание каких-то тем, непонимание вопросов и странные ответы.

«…Тест Тьюринга был впервые пройден суперкомпьютером „Женя Густман“ во время конкурса, состоявшегося в субботу в знаменитом Королевском обществе в Лондоне. Если компьютер более чем в 30% случаев принимают за человека во время пятиминутного общения, то он проходит тест. До сих пор ни один компьютер не смог этого добиться. Евгению удалось убедить 33% судей в том, что он человек».

Далеко не все с этим согласились.

«Программа добилась успеха с помощью „уловок“, призванных скрыть её ограничения. Когда „Густман“ не в своей тарелке — а это происходит большую часть времени, он пытается сменить тему, если это возможно, задаёт вопросы, направляет разговор в нужное русло и иногда вбрасывает немного юмора».

Гари Маркус,

профессор когнитивных наук Нью-Йоркского университета, из статьи «Что будет после теста Тьюринга?»

Кстати, в 1991 году была учреждена премия Лёбнера (Loebner Prize): первой программе, прошедшей стандартный тест Тьюринга, обещали вручить серебряную медаль и 25 000 долларов. Несмотря на то, что каждый год выбирались победители, ни одна программа не прошла тест. Профессор MIT Марвин Мински называл премию Лёбнера «глупой» и предложил деньги тому, кто сможет убедить Лёбнера отказаться от премии и заняться своими делами. С 2020 года конкурс не проводится.

Тест и ИИ

Специалисты в области ИИ вообще не считают прохождение теста Тьюринга каким-то важным показателем.

«Почти никто в области ИИ не работает над прохождением теста Тьюринга, разве что в качестве хобби. Есть люди, которые участвуют в различных соревнованиях, но я бы не назвал это основными исследованиями в области ИИ».

Стюарт Рассел,

исследователь ИИ из штата Калифорния (США), в интервью журналу Business Insider

Но в то же время тест способствовал развитию этой сферы, потому что многие создавали свои программы в надежде пройти его.

«Как я понял за два десятилетия работы в качестве когнитолога, настоящая ценность теста Тьюринга заключается в чувстве соперничества, которое он вызывает у программистов и инженеров».

Гари Маркус,

профессор когнитивных наук Нью-Йоркского университета, из статьи «Что будет после теста Тьюринга?»

Появились различные вариации теста. Наиболее известная — обратный тест Тьюринга. Здесь участники теста пытаются имитировать компьютерную программу, намеренно игнорируя смысл разговора и допуская ошибки, которые могла бы допустить машина.

Самой известной вариацией обратного теста Тьюринга, с которой сталкивался почти каждый пользователь интернета, можно считать CAPTCHA (completely automated public Turing test to tell computers and humans apart). В наиболее распространённой версии CAPTCHA программа требует ввести буквы и цифры с картинки, чтобы доказать, что ты человек.

Что дальше?

Исследователи Джошуа Фокс и Цви Шрайбер считают, что в будущем более актуальными будут другие тесты:

- Обратный тест Тьюринга: человек-испытуемый пытается соответствовать ChatGPT.

- Тест на киборгов: ChatGPT будет соревноваться с командой людей, которым разрешено пользоваться определёнными вычислительными сервисами, например Google.

Ещё в 2002 году знаменитый информатик, изобретатель и футурист Рэй Курцвейл заявил, что компьютер пройдёт тест Тьюринга к 2029 году. А Митчелл Капор, предприниматель, сооснователь Фонда электронных рубежей и Mozilla Foundation с ним не согласился. И они заключили пари на 20 тысяч долларов. Капор считает, что машина никогда не научится «сплетать вещи по-новому», не будет обладать истинным воображением, как у людей, и вообще, человек сильно сложнее, чем кажется. Курцвейл верит в компьютеры.

Больше интересного про код в нашем телеграм-канале. Подписывайтесь!

Читайте также: