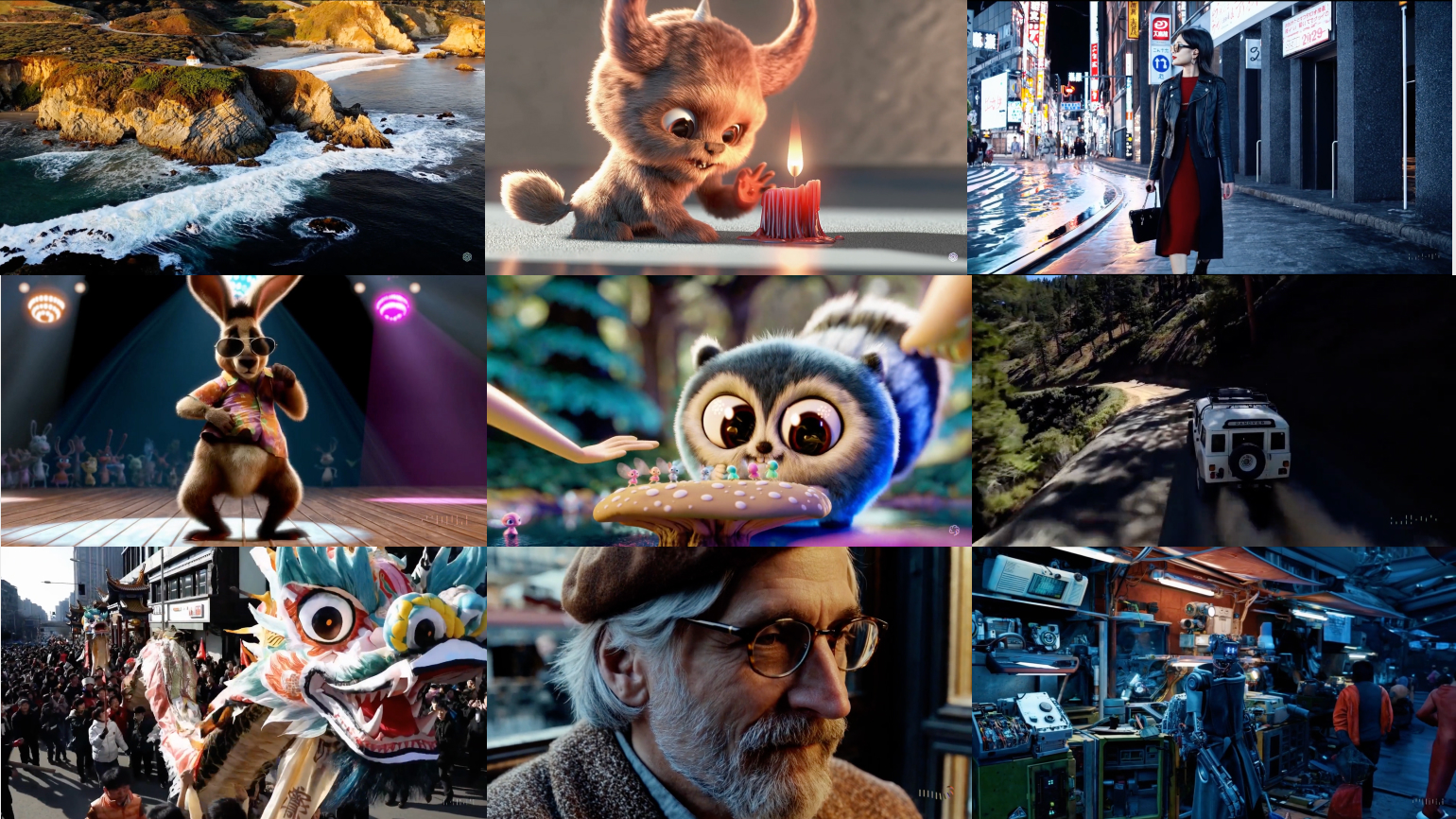

OpenAI представила нейросеть Sora для генерации видео по текстовому описанию. Ролики получаются плавными и с обилием деталей, а модель запоминает персонажей и может показывать их с разных ракурсов.

Кадры: OpenAI

ChatGPT для видео

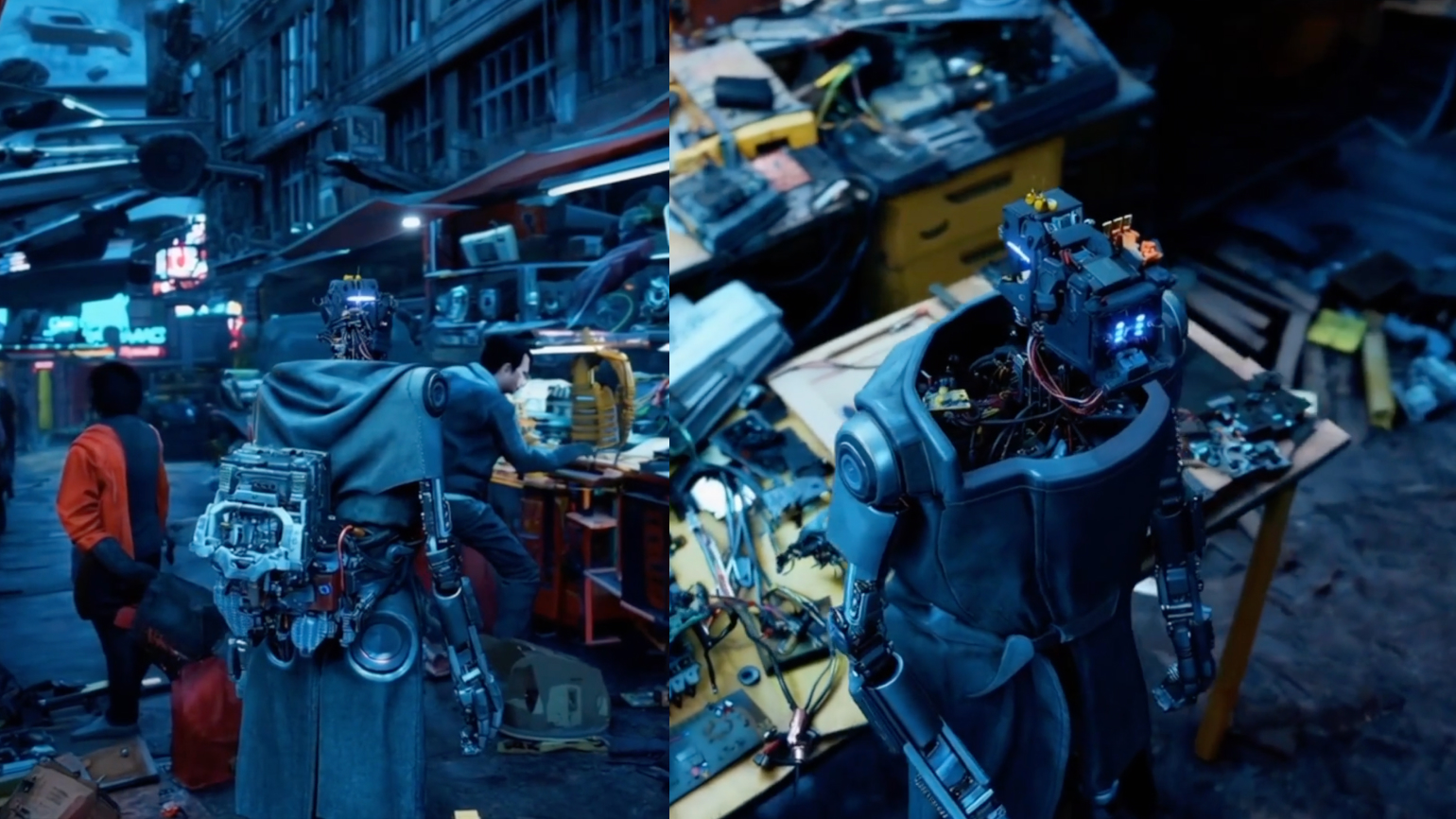

В блоге OpenAI отмечается, что Sora может генерировать сложные сцены с несколькими героями, в которых прописаны характерные для них движения и точные детали фона. Модель не только точно передаёт текстовый запрос, но и учитывает, как конечные объекты взаимодействуют друг с другом в физическом мире.

Sora, как заявляет компания, может понимать сложные текстовые запросы, включающие в себя описание нескольких персонажей и действий. Кроме того, нейросеть запоминает внешний вид основных действующих лиц. Это позволяет использовать одного и того же персонажа в разных локациях.

Разработчики отмечают, что у нынешней версии Sora есть свои слабые стороны. В сложных сценах нейросеть может не до конца формировать причинно-следственную связь. К примеру, человек в кадре откусывает печенье и начинает его жевать, но само печенье остаётся целым. Кроме того, иногда модель искажает объекты и придаёт им нетипичные физические свойства. В одном из примеров компания показала, как стул из твёрдого пластика стал практически жидким.

Безопасность

OpenAI рассказала, что работает с командами экспертов, которые помогут настроить и внедрить системы защиты от ложной информации. Компания пока только рассматривает возможные способы защиты. К примеру, все сгенерированные видео будут автоматически снабжаться специальной меткой в метаданных, чтобы пользователи могли быстро отличить реальное видео от созданного Sora.

Уже сейчас нейросеть использует фильтры, которые не разрешают генерировать видео на некоторые темы и с использованием некоторых персонажей. Эти же системы защиты отвечают за фильтрацию создаваемого контента в ChatGPT и DALL-E.

Технологии

Sora — диффузионная модель, в которой первый этап генерации видео начинается с создания статического шума. Постепенно уровень шума снижается — и тогда проявляется изображение. Нейросеть генерирует сразу целое видео, а не ключевые кадры, пространство между которыми заполняется на следующих этапах. Благодаря этому получается сохранить целостность сюжета и объектов в кадре. Кроме того, Sora может дополнить уже существующий ролик, сохраняя детали.

OpenAI отмечает, что инженерам компании удалось решить проблему сохранения внешнего вида объекта даже в тех случаях, когда он исчезает из кадра. Другие модели машинного обучения деформируют его или полностью меняют на схожий.

Кадры: OpenAI

Как получить доступ

Компания пока проводит закрытое тестирование среди небольшой группы инженеров, кинематографистов и дизайнеров. После сбора отзывов OpenAI планирует доработать модель машинного обучения и включить её в список общедоступных продуктов. Пока нет информации о дате релиза.

Примеры работы Sora опубликованы на официальном сайте OpenAI. Пользовательские запросы можно посмотреть в профиле Сэма Альтмана в социальной сети X. После анонса Sora он предложил подписчикам придумать запросы и сгенерировал по ним видеоролики.

Больше интересного про код — в нашем телеграм-канале. Подписывайтесь!