NVIDIA представила поколение ИИ-чипов на новой архитектуре Blackwell. Графический ускоритель B200 позволяет разработчикам обучать нейросети с триллионами параметров, тратя на это меньше времени и энергии. При этом компания заявляет производительность до 20 петафлопс.

Кадр: NVIDIA / YouTube

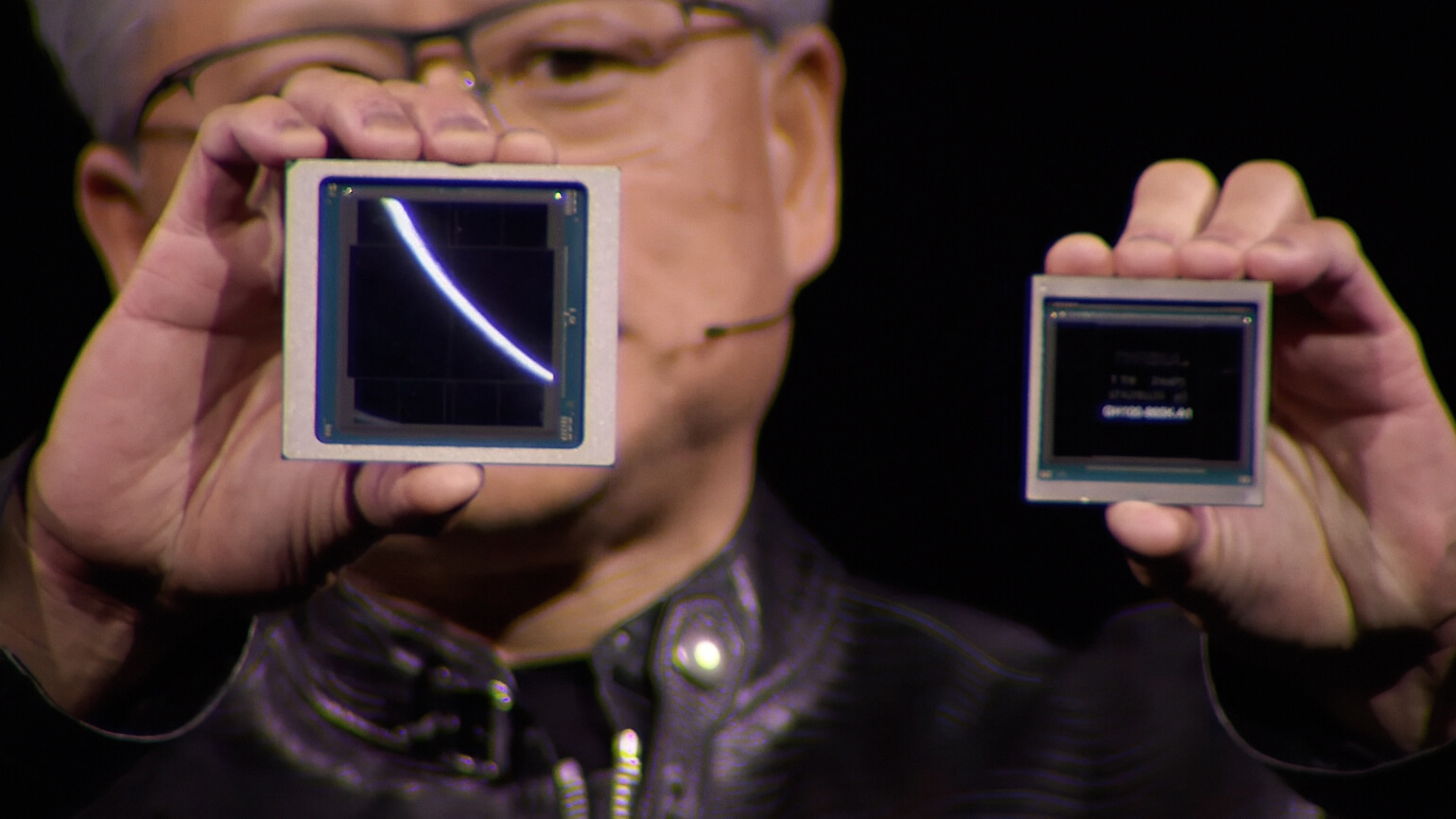

Чипы Blackwell

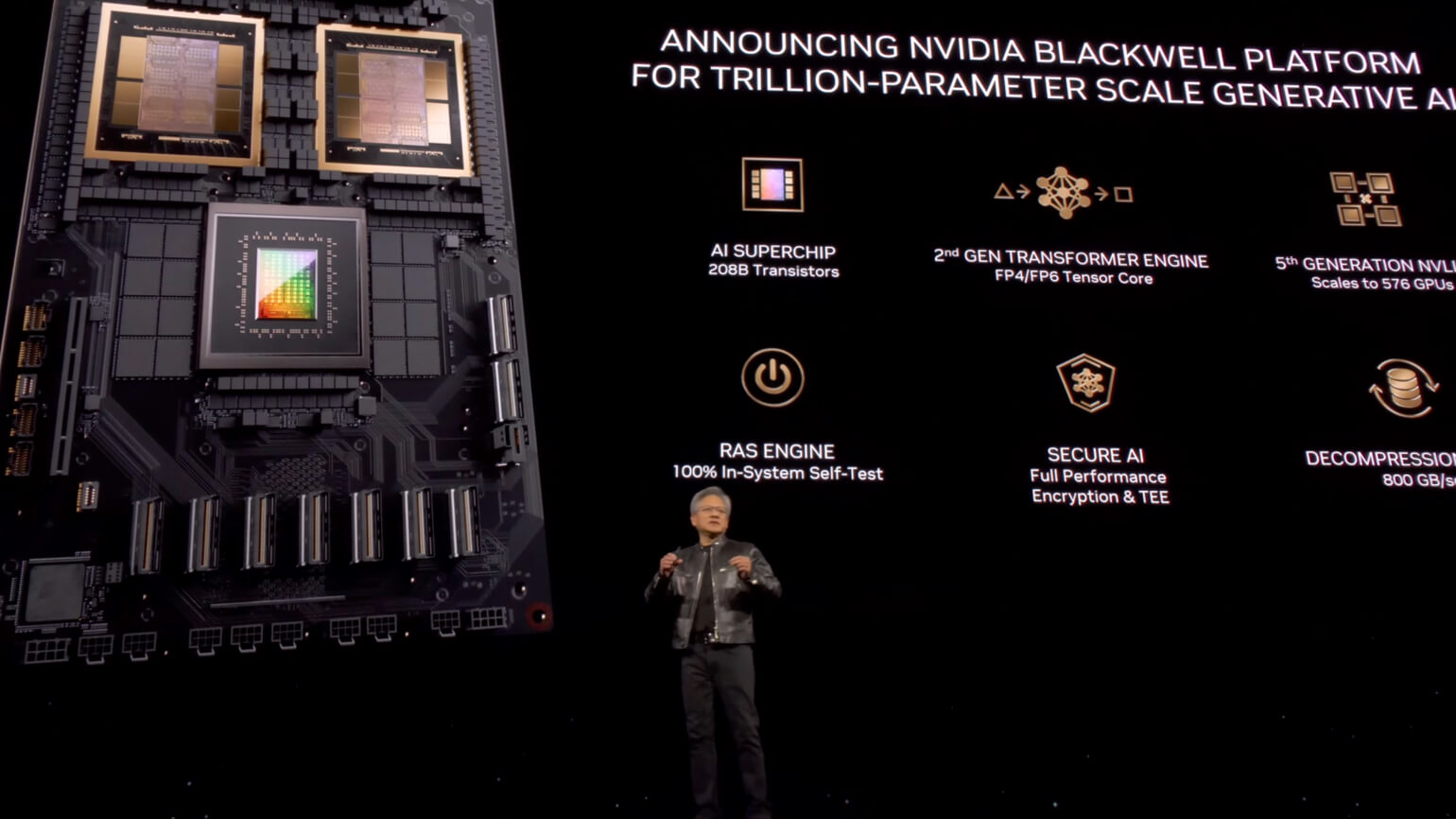

Blackwell B200 выполнен по четырёхнанометровому техпроцессу компании TSMC и состоит из 208 миллиардов транзисторов. Общий объём памяти составляет 192 ГБ с пропускной способностью до 8 ТБ/с. NVIDIA рассказала, что новая архитектура позволяет нескольким процессорам быстрее передавать данные друг другу. Ранее кластер из 16 графических ускорителей 60% времени тратил на коммуникацию между процессорами.

Базовым устройством в новой линейке станет карта GB200 на базе двух чипов B200. Её можно будет использовать как отдельно, так и в связке с другой. Производительность видеокарты оценивается в 20 петафлопс. Для сравнения: PlayStation 5 в 2200 раз слабее — всего 10,3 терафлопса.

Кадр: NVIDIA / YouTube

Для продвинутых пользователей NVIDIA выпустит серверную стойку GB200 NVL72. В ней будет установлено 72 GPU нового поколения. Общая вычислительная мощность составит 1,4 экзафлопс (1440 петафлопс). Для охлаждения устройства планируют использовать жидкостную систему. Amazon, Google, Microsoft и Oracle уже рассматривают покупку стоек для своих облачных платформ.

Кадр: NVIDIA / YouTube

Большим компаниям будет доступен сервер из восьми стоек с 576 видеокартами нового поколения. Его производительность оценивается в 11,5 экзафлопс. Если этого будет мало, то несколько серверов можно связать друг с другом.

Кадр: NVIDIA / YouTube

Преимущества

Сейчас для обучения языковой модели с 1,8 триллиона параметров, что эквивалентно GPT-4, понадобится 8 тысяч графических ускорителей на архитектуре Hopper. Процесс займёт 90 дней и потребует 15 мегаватт мощности. С Blackwell понадобится всего 2 тысячи GPU и 4 мегаватта.

Новая архитектура ускоряет обучение нейросетей и делает его более энергоэффективным. Это важно для компаний, которые разрабатывают большие модели машинного обучения с огромным количеством параметров.

Больше интересного про код — в нашем телеграм-канале. Подписывайтесь!