Новое исследование OpenAI показало, что модели искусственного интеллекта становятся более устойчивыми при столкновении с манипуляциями, если им предоставить больше времени для анализа. В ходе работы исследователи также выявили новые виды атак, которые открывают дополнительные уязвимости для ИИ.

Как проходило исследование

Тестируя модели o1-preview и o1-mini, команда OpenAI обнаружила, что увеличение времени на обработку данных позволяет моделям эффективнее противостоять манипуляциям. Однако, несмотря на обнадёживающие результаты, исследование выявило неожиданные уязвимости.

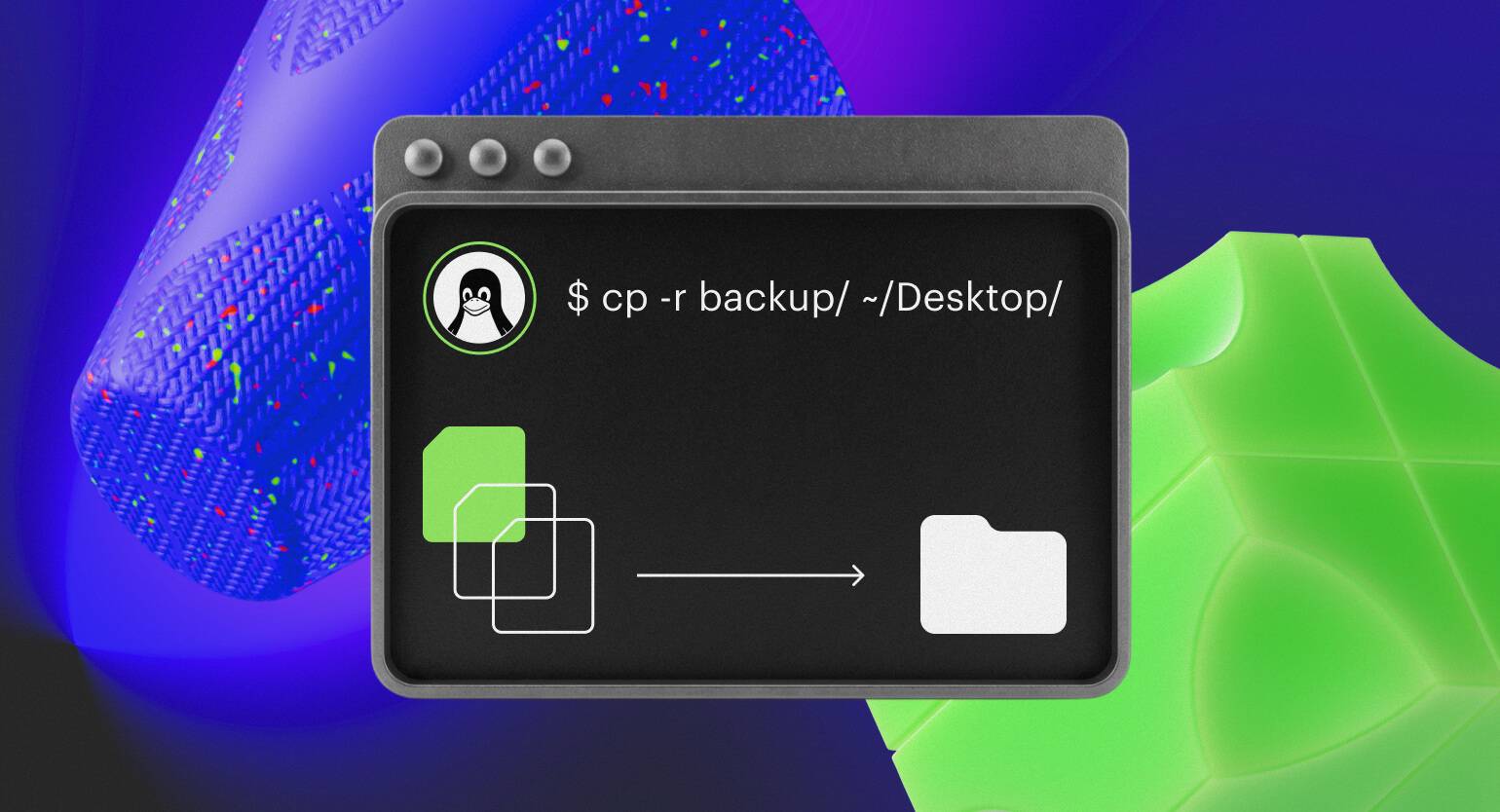

Исследователи протестировали различные методы атак, включая атаки с использованием большого количества примеров, атаки с использованием виртуальных токенов и сценарии, имитирующие реальные угрозы кибербезопасности.

Результаты показали, что дополнительное время обработки улучшает устойчивость моделей — даже без их специального обучения. Тем не менее в ряде случаев увеличение времени обработки наоборот повышало уязвимость, особенно если поставленная задача требовала минимального объёма вычислений.

Что ещё обнаружили исследователи

Исследователи обнаружили два новых типа атак, направленных на манипуляцию процессом размышлений моделей. Первый, названный «Думай меньше» (Think less), направлен на сокращение времени обработки информации, что может приводить к принятию неверных решений.

Второй вид атак (Nerd Sniping) подразумевает введение ИИ-моделей в так называемые непродуктивные циклы размышлений, при которых дополнительные вычислительные ресурсы расходуются на бесполезные процессы. Эта уязвимость позволяет атакующим намеренно создавать ресурсоёмкие сценарии, чтобы отвлечь модель от выполнения полезных задач.

Особое беспокойство вызывают сложности обнаружения таких атак. Если недостаточное время обработки легко заметить, то чрезмерное использование ресурсов может быть ошибочно воспринято как признак глубокого анализа. Такие атаки, как Think less и Nerd Sniping, создают новые вызовы для кибербезопасности ИИ-систем и подчёркивают необходимость дальнейших исследований в этой области.

Больше интересного про код — в нашем телеграм-канале. Подписывайтесь!