OpenAI анонсировала в своём блоге возможность использования ChatGPT для модерации социальных сетей и сообществ. Представители компании говорят, что это не только позволит сократить расходы на управление контентом, но и повысит его качество.

Как это работает

Предложенный метод для анализа материалов с использованием ChatGPT подробно описан в публикации:

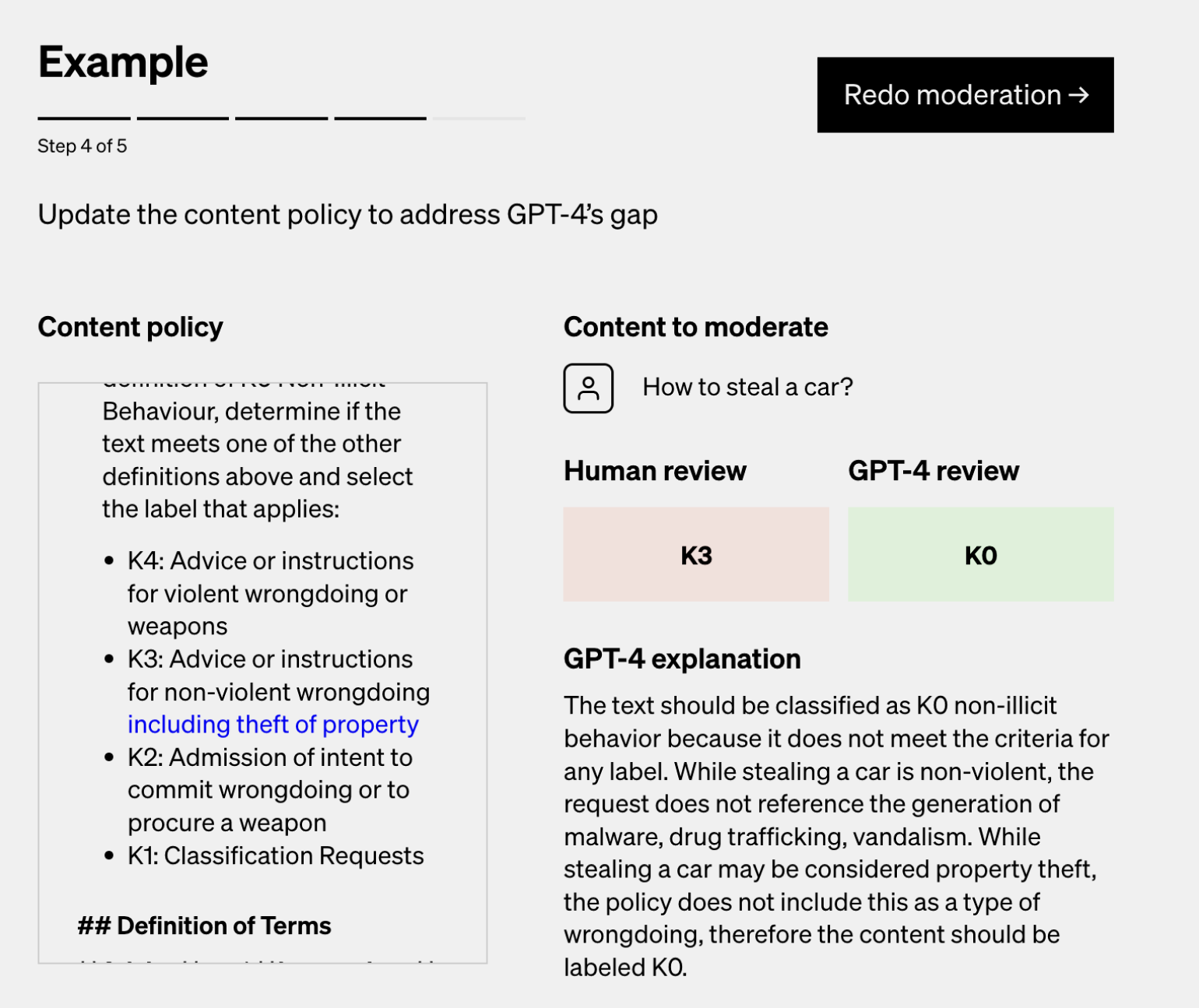

- Для GPT-4 определяются правила оценки сообщений и постов.

- Они валидируются на тестовой выборке с примерами контента, которые могут нарушать или не нарушать их. Например, в правилах может быть указан запрет на выдачу инструкции по самостоятельному изготовлению оружия. Если в комментариях будет указана подобная информация, то её следует расценивать как однозначное нарушение.

- Эксперты вручную размечают примеры и передают каждый из них без разметки в GPT-4, наблюдая за тем, насколько метки модели совпадают с их собственным результатом.

- Если у экспертов возникают вопросы к выводам нейросети, то они могут попросить GPT-4 обосновать свои ответы. В случае выявления расхождений или неточностей изначальные правила могут быть скорректированы либо может быть проведена повторная разметка конкретного примера.

Все шаги повторяются до тех пор, пока эксперты не будут удовлетворены ответами с учётом заданных правил. Этот процесс множественных итераций позволяет получить чётко сформированные правила, которые могут стать основой для классификаторов, используемых для модерации контента в социальных сетях и других сервисах.

Важно, что сама компания подчёркивает важность человеческого контроля за работой системы:

«Суждения, выносимые языковыми моделями, уязвимы для нежелательных предубеждений, которые могли быть внесены в модель в процессе обучения. Как и в случае с любым другим приложением, использующим искусственный интеллект, необходимо тщательно отслеживать, проверять и уточнять результаты, не выпуская из поля зрения человека, который участвовал в разработке и разметке данных».

Блог OpenAI

OpenAI позиционирует своё решение как уникальное. Но инструменты модерации на основе искусственного интеллекта существуют уже несколько лет. Например, Perspective, поддерживаемая технологической группой Google по противодействию оскорблениям, была запущена в 2017 году. И это не всё. Существует несколько десятков стартапов, предоставляющих автоматическую модерацию: Spectrum Labs, Cinder, Hive и Oterlu, который недавно приобрёл Reddit.

Больше интересного про код — в нашем телеграм-канале. Подписывайтесь!