OpenAI выпустила новую версию модели для разработчиков GPT-5.3-Codex-Spark. Её главное отличие от «рассуждающих» нейросетей компании — работа в реальном времени с большим контекстным окном, что позволяет сохранить точность при максимальной скорости генерации кода.

Попробовать GPT-5.3-Codex-Spark уже могут пользователи с подпиской ChatGPT Pro — например, в приложении Codex, терминале или IDE-плагинах.

Что нового в GPT-5.3-Codex-Spark

GPT-5.3-Codex-Spark — быстрая версия модели для программистов, дополняющая GPT-5.3-Codex, рассчитанную на автономные задачи. Её ключевые особенности:

- высокая скорость генерации — Codex-Spark выдаёт более тысячи токенов в секунду, почти мгновенно реагируя на запросы и правки кода;

- использование нового чипа — модель работает не на обычных графических процессорах NVIDIA, а на специализированных ускорителях Cerebras Wafer Scale Engine 3, что увеличивает пропускную способность и снижает задержки;

- интерактивный режим взаимодействия — модель спроектирована так, чтобы пользователь мог сразу менять запросы, получать обновления кода и продолжать работу без пауз, как с живым коллегой;

- меньший размер, высокая эффективность — Spark легче и быстрее, чем флагманская GPT-5.3-Codex, но при этом остаётся достаточно мощной моделью для решения реальных задач разработчиков.

Эти изменения делают Codex-Spark особенно полезной там, где важна скорость отклика и внесения изменений — например при правке существующего кода и быстрой проверке гипотез прямо во время разработки.

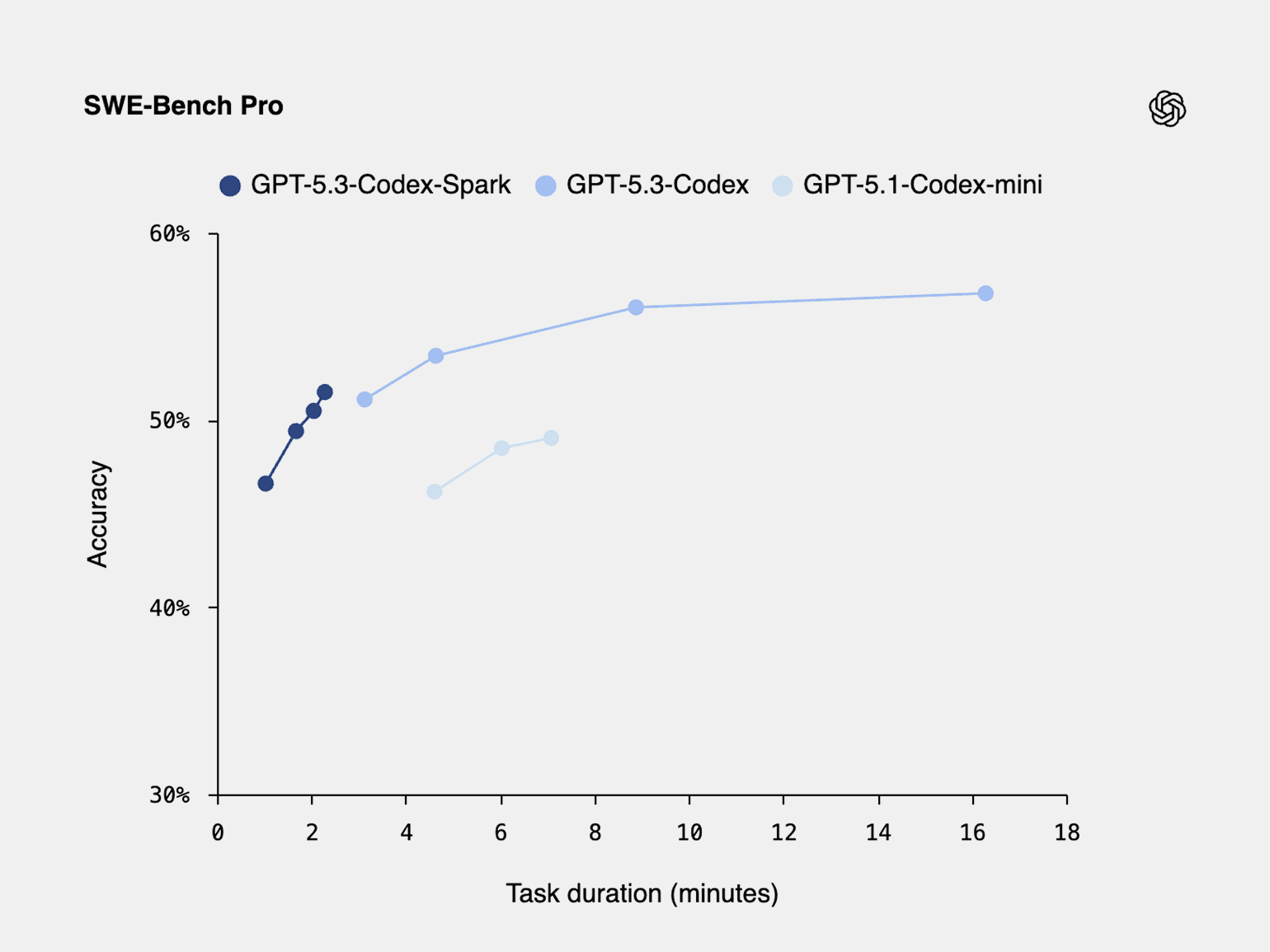

Что показывают бенчмарки

Результаты моделей на стандартизированных тестах помогают понять, насколько хорошо они справляются с практическими задачами. Для Codex-Spark OpenAI приводит такие оценки:

- на SWE-Bench Pro — бенчмарке, оценивающем реальные задачи программирования на нескольких языках, — Spark набирает около 52%, тогда как старшая GPT-5.3-Codex показывает примерно 57%;

- на Terminal-Bench 2.0 — тесте навыков работы в терминале и при решении интерактивных задач — Spark показывает около 58,4%, что ниже, чем у флагманской версии (~77,3%), но выше, чем у предыдущих мини-версий моделей.

Бенчмарки показывают, что Codex-Spark позволяет решать задачи разработчиков на приемлемом уровне, схожем с уровнем размышляющих моделей. При этом делает она это быстрее.

Изображение: OpenAI

Больше интересного про код — в нашем телеграм-канале. Подписывайтесь!